Estimateur cohérent - Consistent estimator

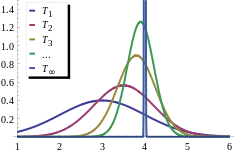

Dans les statistiques , un estimateur ou estimateur asymptotiquement consistant est un estimateur règle -a pour calculer les estimations d'un paramètre thetav 0 -vu la propriété que , lorsque le nombre de points de données utilisé augmente indéfiniment, la séquence résultante d'estimations converge en probabilité de & thetav 0 . Cela signifie que les distributions des estimations deviennent de plus en plus concentrées près de la vraie valeur du paramètre estimé, de sorte que la probabilité que l'estimateur soit arbitrairement proche de θ 0 converge vers un.

En pratique on construit un estimateur en fonction d'un échantillon disponible de taille n , puis on imagine pouvoir continuer à collecter des données et élargir l'échantillon à l' infini . De cette façon, on obtiendrait une séquence d'estimations indexées par n , et la cohérence est une propriété de ce qui se produit lorsque la taille de l'échantillon « grandit jusqu'à l'infini ». S'il est possible de démontrer mathématiquement que la séquence d'estimations converge en probabilité vers la vraie valeur θ 0 , on l'appelle un estimateur cohérent ; sinon, l'estimateur est dit incohérent .

La cohérence telle que définie ici est parfois appelée cohérence faible . Lorsque nous remplaçons la convergence en probabilité par une convergence presque sûre , alors l'estimateur est dit fortement cohérent . La cohérence est liée au biais ; voir biais versus cohérence .

Définition

Formellement parlant, un estimateur T n du paramètre θ est dit consistant , s'il converge en probabilité vers la vraie valeur du paramètre :

c'est-à-dire si, pour tout ε > 0

Une définition plus rigoureuse tient compte du fait que θ est en fait inconnu, et donc la convergence en probabilité doit avoir lieu pour toutes les valeurs possibles de ce paramètre. Supposons que { p θ : θ ∈ Θ } est une famille de distributions (le modèle paramétrique ), et X θ = { X 1 , X 2 , … : X i ~ p θ } est un échantillon infini de la distribution p θ . Soit { T n ( X θ ) } une séquence d'estimateurs pour un paramètre g ( θ ). Habituellement, T n sera basé sur les n premières observations d'un échantillon. Alors cette suite { T n } est dite (faiblement) cohérente si

Cette définition utilise g ( θ ) au lieu de simplement θ , car on s'intéresse souvent à l'estimation d'une certaine fonction ou d'un sous-vecteur du paramètre sous-jacent. Dans l'exemple suivant, nous estimons le paramètre d'emplacement du modèle, mais pas l'échelle :

Exemples

Moyenne de l'échantillon d'une variable aléatoire normale

Supposons que l'on ait une séquence d'observations { X 1 , X 2 , ...} à partir d'une distribution normale N ( μ , σ 2 ) . Pour estimer μ sur la base des n premières observations, on peut utiliser la moyenne de l' échantillon : T n = ( X 1 + ... + X n )/ n . Cela définit une séquence d'estimateurs, indexée par la taille de l'échantillon n .

A partir des propriétés de la distribution normale, nous connaissons la distribution d'échantillonnage de cette statistique : T n est elle-même distribuée normalement, de moyenne μ et de variance σ 2 / n . De manière équivalente, a une distribution normale standard :

comme n tend vers l' infini, pour tout fixe ε > 0 . Par conséquent, la séquence T n de moyens échantillon est uniforme pour la population moyenne μ ( en rappelant que le distribution cumulative de la distribution normale).

Établir la cohérence

La notion de consistance asymptotique est très proche, presque synonyme de la notion de convergence en probabilité. En tant que tel, tout théorème, lemme ou propriété qui établit la convergence en probabilité peut être utilisé pour prouver la cohérence. De nombreux outils de ce type existent :

- Afin de démontrer la cohérence directement à partir de la définition, on peut utiliser l'inégalité

le choix le plus courant pour la fonction h étant soit la valeur absolue (auquel cas elle est connue sous le nom d' inégalité de Markov ), soit la fonction quadratique (respectivement l'inégalité de Chebyshev ).

- Un autre résultat utile est le théorème d'application continue : si T n est cohérent pour θ et g (·) est une fonction à valeur réelle continue au point θ , alors g ( T n ) sera cohérent pour g ( θ ) :

- Le théorème de Slutsky peut être utilisé pour combiner plusieurs estimateurs différents, ou un estimateur avec une séquence convergente non aléatoire. Si T n → d α , et S n → p β , alors

- Si l'estimateur T n est donné par une formule explicite, alors très probablement la formule emploiera des sommes de variables aléatoires, et alors la loi des grands nombres peut être utilisée : pour une séquence { X n } de variables aléatoires et dans des conditions appropriées,

- Si l'estimateur T n est défini implicitement, par exemple comme une valeur qui maximise une certaine fonction objectif (voir l' estimateur extremum ), alors un argument plus compliqué impliquant l'équicontinuité stochastique doit être utilisé.

Biais contre cohérence

Impartial mais pas cohérent

Un estimateur peut être sans biais mais non cohérent. Par exemple, pour un échantillon iid { x

1,..., x

m} on peut utiliser T

m( X ) = x

mcomme estimateur de la moyenne E[ x ]. Notez qu'ici la distribution d'échantillonnage de T

mest la même que la distribution sous-jacente (pour tout n, car elle ignore tous les points sauf le dernier), donc E[ T

m( X )] = E[ x ] et il est sans biais, mais il ne converge vers aucune valeur.

Cependant, si une séquence d'estimateurs est sans biais et converge vers une valeur, alors elle est cohérente, car elle doit converger vers la valeur correcte.

Biais mais cohérent

Alternativement, un estimateur peut être biaisé mais cohérent. Par exemple, si la moyenne est estimée par elle est biaisée, mais comme , elle s'approche de la valeur correcte et est donc cohérente.

Des exemples importants incluent la variance de l' échantillon et l' écart type de l'échantillon . Sans la correction de Bessel (c'est-à-dire lorsque l'on utilise la taille de l'échantillon au lieu des degrés de liberté ), ce sont à la fois des estimateurs biaisés négativement mais cohérents. Avec la correction, la variance de l'échantillon corrigée est sans biais, tandis que l'écart type de l'échantillon corrigé est toujours biaisé, mais moins, et les deux sont toujours cohérents : le facteur de correction converge vers 1 à mesure que la taille de l'échantillon augmente.

Voici un autre exemple. Soit une séquence d'estimateurs pour .

Nous pouvons voir que , , et le biais ne converge pas vers zéro.

Voir également

- Estimateur efficace

- Cohérence de Fisher — concept de cohérence alternatif, bien que rarement utilisé pour les estimateurs

- Dilution de régression

- Test d'hypothèses statistiques

Remarques

Les références

- Amemiya, Takeshi (1985). Econométrie avancée . Presse de l'Université Harvard . ISBN 0-674-00560-0.

- Lehmann, EL ; Casella, G. (1998). Théorie de l'estimation ponctuelle (2e éd.). Springer. ISBN 0-387-98502-6.

- Newey, WK ; McFadden, D. (1994). "Chapitre 36 : Estimation d'un grand échantillon et test d'hypothèse". Dans Robert F. Engle ; Daniel L. McFadden (éd.). Manuel d'économétrie . 4 . Elsevier Science. ISBN 0-444-88766-0. S2CID 29436457 .

- Nikulin, MS (2001) [1994], "Consistent estimateur" , Encyclopedia of Mathematics , EMS Press

- Sober, E. (1988), "Probabilité et convergence", Philosophie des sciences , 55 (2) : 228-237, doi : 10.1086/289429.

![\Pr \!\left[\,|T_{n}-\mu |\geq \varepsilon \,\right]=\Pr \!\left[{\frac {{\sqrt {n}}\,{\ big |}T_{n}-\mu {\big |}}{\sigma }}\geq {\sqrt {n}}\varepsilon /\sigma \right]=2\left(1-\Phi \left( {\frac {{\sqrt {n}}\,\varepsilon }{\sigma }}\right)\right)\to 0](https://wikimedia.org/api/rest_v1/media/math/render/svg/1427f3a9408cdda24cd8bfd6187fd3159d686ea1)

![{\displaystyle \Pr \!{\big [}h(T_{n}-\theta )\geq \varepsilon {\big ]}\leq {\frac {\operatorname {E} {\big [}h(T_ {n}-\theta ){\big ]}}{h(\varepsilon )}},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2f85b6918244bbc21064136cadbed4a801549fad)

![{\frac {1}{n}}\sum _{{i=1}}^{n}g(X_{i})\ {\xrightarrow {p}}\ \operatorname {E}[\,g( X)\,]](https://wikimedia.org/api/rest_v1/media/math/render/svg/10b736680a0d0837ea1290104d9acca589aa63f4)

![{\displaystyle \operatorname {E} [T_{n}]=\theta +\delta }](https://wikimedia.org/api/rest_v1/media/math/render/svg/88d36066b1ca8f168ef6c72d6650e8eedcf80d22)