Distribution gamma - Gamma distribution

|

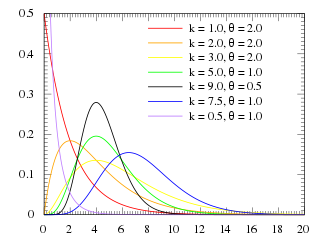

Fonction de densité de probabilité

| |||

|

Fonction de distribution cumulative

| |||

| Paramètres | |||

|---|---|---|---|

| Soutien | |||

| CDF | |||

| Moyenne | |||

| Médian | Pas de forme fermée simple | Pas de forme fermée simple | |

| Mode | |||

| Variance | |||

| Asymétrie | |||

| Ex. aplatissement | |||

| Entropie | |||

| MGF | |||

| FC | |||

| Méthode des moments | |||

En théorie des probabilités et en statistiques , la distribution gamma est une famille à deux paramètres de distributions de probabilité continues . La distribution exponentielle , la distribution Erlang , et la distribution du chi-carré sont des cas particuliers de la distribution gamma. Il existe deux paramétrages différents couramment utilisés :

- Avec un paramètre de forme k et un paramètre d'échelle θ .

- Avec un paramètre de forme α = k et un paramètre d'échelle inverse β = 1 / θ , appelée paramètre de débit .

Dans chacune de ces formes, les deux paramètres sont des nombres réels positifs.

La distribution gamma est la distribution de probabilité d'entropie maximale ( à la fois par rapport à une mesure de base uniforme et par rapport à un 1 / x mesure de base) pour une variable aléatoire X pour lequel E [ X ] = kθ = α / β est fixe et supérieur que zéro, et E [ln( X )] = ψ ( k ) + ln( θ ) = ψ ( α ) − ln( β ) est fixe ( ψ est la fonction digamma ).

Définitions

Le paramétrage avec k et thetav semble être plus courante dans économétrie et certains autres domaines appliqués, où par exemple la distribution gamma est fréquemment utilisée pour les temps d' attente du modèle. Par exemple, dans les tests de vie , le temps d'attente jusqu'à la mort est une variable aléatoire qui est fréquemment modélisée avec une distribution gamma. Voir Hogg et Craig pour une motivation explicite.

La paramétrisation avec α et β en est plus fréquent des statistiques bayésiennes , où la distribution gamma est utilisé en tant que préalable conjugué de distribution de différents types de paramètres échelle inverse (taux), tels que le λ d'une distribution exponentielle ou une distribution de Poisson - ou d' ailleurs, la β de la distribution gamma lui - même. La distribution gamma inverse étroitement liée est utilisée comme a priori conjugué pour les paramètres d'échelle, tels que la variance d'une distribution normale .

Si k est un entier positif , alors la distribution représente une distribution d' Erlang ; à savoir, la somme de k indépendant exponentiellement distribué des variables aléatoires , dont chacune a une moyenne de θ .

Caractérisation par forme α et taux β

La distribution gamma peut être paramétré en fonction d'un paramètre de forme α = k et un paramètre d'échelle inverse β = 1 / θ , appelée paramètre de débit . Une variable aléatoire X qui est gamma-distribuée avec la forme α et le taux β est notée

La fonction de densité de probabilité correspondante dans la paramétrisation du taux de forme est

où est la fonction gamma . Pour tous les entiers positifs, .

La fonction de distribution cumulée est la fonction gamma régularisée :

où est la fonction gamma incomplète inférieure .

Si α est un entier positif (c'est-à-dire que la distribution est une distribution d'Erlang ), la fonction de distribution cumulative a le développement en série suivant :

Caractérisation à l'aide de la forme k et de l'échelle θ

Une variable aléatoire X qui est le gamma-forme distribuée avec k et l' échelle θ est désignée par

La fonction de densité de probabilité utilisant la paramétrisation de l'échelle de forme est

Ici Γ( k ) est la fonction gamma évaluée en k .

La fonction de distribution cumulée est la fonction gamma régularisée :

où est la fonction gamma incomplète inférieure .

Il peut également être exprimé comme suit, si k est un entier positif (c'est-à-dire que la distribution est une distribution d'Erlang ):

Les deux paramétrages sont communs car l'un ou l'autre peut être plus pratique selon la situation.

Propriétés

Asymétrie

L'asymétrie de la distribution gamma ne dépend que de son paramètre de forme, k , et elle est égale à

Des moments plus élevés

Le n ième moment brut est donné par :

Approximations médianes et bornes

Contrairement au mode et à la moyenne, qui ont des formules facilement calculables basées sur les paramètres, la médiane n'a pas d'équation fermée. La médiane de cette distribution est définie comme la valeur telle que

Un traitement rigoureux du problème de détermination d'un développement asymptotique et de bornes pour la médiane de la distribution gamma a été traité en premier par Chen et Rubin, qui ont prouvé que (pour )

où est la moyenne et est la médiane de la distribution. Pour les autres valeurs du paramètre d'échelle, la moyenne s'échelonne jusqu'à , et les limites et approximations médianes seraient également mises à l'échelle de .

KP Choi a trouvé les cinq premiers termes d'une approximation asymptotique de la médiane en série de Laurent en comparant la médiane à la fonction de Ramanujan . Berg et Pedersen ont trouvé plus de termes :

Les sommes partielles de ces séries sont de bonnes approximations car assez élevées ; ils ne sont pas représentés sur la figure, qui se concentre sur la région basse qui est moins bien approchée.

Berg et Pedersen ont également prouvé de nombreuses propriétés de la médiane, ont montré qu'elle est une fonction convexe de , et que le comportement asymptotique près est (où est la constante d'Euler–Mascheroni ), et que pour tout la médiane est bornée par .

Une limite supérieure linéaire plus proche, pour seulement, a été fournie en 2021 par Gaunt et Merkle, en s'appuyant sur le résultat de Berg et Pedersen selon lequel la pente de est partout inférieure à 1 :

- pour (avec égalité en )

qui peut être étendu à une borne pour tout en prenant le max avec la corde montrée sur la figure, puisque la médiane a été prouvée convexe.

Une approximation de la médiane qui est asymptotiquement précise à haut et raisonnable jusqu'à ou un peu plus bas découle de la transformation de Wilson-Hilferty :

qui devient négatif pour .

En 2021, Lyon a proposé plusieurs approximations fermées de la forme . Il a conjecturé des valeurs fermées de et pour lesquelles cette approximation est une limite supérieure ou inférieure asymptotiquement étroite pour tout . En particulier:

- est une borne inférieure, asymptotiquement serrée comme

- est une borne supérieure, asymptotiquement serrée comme

Lyon a également dérivé deux autres bornes inférieures qui ne sont pas des expressions de forme fermée , dont celle-ci basée sur la résolution de l'expression intégrale en substituant 1 à :

- (approche de l'égalité comme )

et la tangente à l' endroit où la dérivée a été trouvée :

- (avec égalité à )

où Ei est l' intégrale exponentielle .

De plus, il a montré que les interpolations entre les limites peuvent fournir d'excellentes approximations ou des limites plus strictes à la médiane, y compris une approximation qui est exacte à (où ) et a une erreur relative maximale inférieure à 0,6 %. Les approximations interpolées et les bornes sont toutes de la forme

où est une fonction d'interpolation fonctionnant de manière monotone de 0 à bas à 1 à haut , se rapprochant d'un interpolateur idéal ou exact :

Pour la fonction d'interpolation la plus simple considérée, une fonction rationnelle du premier ordre

la borne inférieure la plus serrée a

et la borne supérieure la plus serrée a

Les limites interpolées sont tracées (principalement à l'intérieur de la région jaune) dans le tracé log–log indiqué. Des limites encore plus strictes sont disponibles en utilisant différentes fonctions d'interpolation, mais généralement pas avec des paramètres de forme fermée comme ceux-ci.

Addition

Si X i a un gamma ( k i , θ ) distribution pour i = 1, 2, ..., N ( à savoir, toutes les distributions ont le même paramètre d' échelle θ ), puis

à condition que tous les X i soient indépendants .

Pour les cas où les X i sont indépendants mais ont des paramètres d'échelle différents, voir Mathai ou Moschopoulos.

La distribution gamma présente une divisibilité infinie .

Mise à l'échelle

Si

alors, pour tout c > 0,

- par des fonctions génératrices de moments,

ou de manière équivalente, si

- (paramétrage de la vitesse de forme)

En effet, on sait que si X est une va exponentielle de vitesse λ alors cX est une va exponentielle de vitesse λ / c ; la même chose est valable avec les variables Gamma (et cela peut être vérifié en utilisant la fonction génératrice de moment , voir, par exemple, ces notes , 10.4-(ii)): la multiplication par une constante positive c divise le taux (ou, de manière équivalente, multiplie L'échelle).

Famille exponentielle

La distribution gamma est une famille exponentielle à deux paramètres avec des paramètres naturels k − 1 et −1/ θ (équivalent, α − 1 et − β ), et des statistiques naturelles X et ln( X ).

Si le paramètre de forme k est maintenu fixe, la famille de distributions à un paramètre résultante est une famille exponentielle naturelle .

Espérance logarithmique et variance

On peut montrer que

ou équivalent,

où est la fonction digamma . De même,

où est la fonction trigamma .

Ceci peut être dérivé en utilisant la formule de famille exponentielle pour la fonction génératrice de moment de la statistique suffisante , car l'une des statistiques suffisantes de la distribution gamma est ln( x ).

Entropie de l'information

L' entropie de l'information est

Dans le k , θ paramétrisation, l' entropie de l' information est donnée par

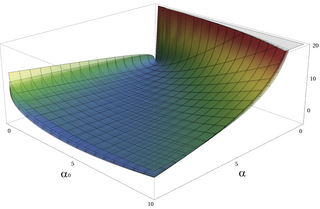

Divergence Kullback-Leibler

La divergence de Kullback-Leibler (KL-divergence), de Gamma ( α p , β p ) (répartition "true") de Gamma ( α q , β q ( "approximativement" distribution)) est donnée par

Écrite en utilisant le k , θ paramétrisation, la divergence de KL-gamma ( k p , θ p ) à partir de Gamma ( k q , θ q ) est donnée par

transformation de Laplace

La transformée de Laplace du gamma PDF est

Distributions associées

Général

- Laissez - être des variables aléatoires indépendantes et identiquement distribuées suivant une distribution exponentielle avec le paramètre de débit λ, alors ~ Gamma (n, λ) où n est le paramètre de forme et λ est le taux, et où le taux change nX .

- Si X ~ Gamma(1, 1/ λ' ) (dans la paramétrisation forme-échelle), alors X a une distribution exponentielle avec le paramètre de vitesse λ .

- Si X ~ Gamma ( ν / 2, 2) (dans la forme paramétrisation échelle), alors X est identique à χ 2 ( ν ), la distribution chi-carré avec v degrés de liberté. Inversement, si Q ~ χ 2 ( ν ) et c est une constante positive, alors cQ ~ Gamma( ν /2, 2 c ).

- Si k est un nombre entier , la distribution gamma est une distribution d' Erlang et la distribution de probabilité du délai d'attente jusqu'à ce que le k ème « arrivée » dans un unidimensionnel processus de Poisson avec une intensité 1 / θ . Si

- alors

- Si X a une distribution de Maxwell-Boltzmann de paramètre a , alors

- Si X ~ Gamma( k , θ ), alors suit une distribution exponentielle-gamma (abrégé exp-gamma). Elle est parfois appelée distribution log-gamma. Les formules pour sa moyenne et sa variance se trouvent dans la section #Espérance et variance logarithmiques .

- Si X ~ Gamma( k , θ ), suit alors une distribution gamma généralisée avec les paramètres p = 2, d = 2 k , et .

- Plus généralement, si X ~ Gamma( k , θ ), alors for suit une distribution gamma généralisée avec les paramètres p = 1/ q , d = k / q , et .

- Si X ~ Gamma( k , θ ) de forme k et d'échelle θ , alors 1/ X ~ Inv-Gamma( k , θ −1 ) (voir Distribution gamma inverse pour la dérivation).

- Paramétrage 1 : Si sont indépendants, alors , ou de manière équivalente,

- Paramétrage 2 : Si sont indépendants, alors , ou de manière équivalente,

- Si X ~ Gamma( α , θ ) et Y ~ Gamma( β , θ ) sont distribués indépendamment, alors X /( X + Y ) a une distribution bêta avec les paramètres α et β , et X /( X + Y ) est indépendant de X + Y , qui est Gamma( α + β , θ )-distribué.

- Si X i ~ Gamma( α i , 1) sont distribués indépendamment, alors le vecteur ( X 1 / S , ..., X n / S ), où S = X 1 + ... + X n , suit un Dirichlet distribution avec les paramètres α 1 , ..., α n .

- Pour k grand, la distribution gamma converge vers une distribution normale avec une moyenne μ = kθ et une variance σ 2 = kθ 2 .

- La distribution gamma est le conjugué a priori de la précision de la distribution normale avec une moyenne connue .

- La distribution de Wishart est une généralisation multivariée de la distribution gamma (les échantillons sont des matrices définies positives plutôt que des nombres réels positifs).

- La distribution gamma est un cas particulier de la distribution gamma généralisée , de la distribution gamma entière généralisée et de la distribution gaussienne inverse généralisée .

- Parmi les distributions discrètes, la distribution binomiale négative est parfois considérée comme l'analogue discret de la distribution gamma.

- Distributions de Tweedie – la distribution gamma fait partie de la famille des modèles de dispersion exponentielle de Tweedie .

Gamma composé

Si le paramètre de forme de la distribution gamma est connu, mais que le paramètre d'échelle inverse est inconnu, alors une distribution gamma pour l'échelle inverse forme un a priori conjugué. La distribution composée , qui résulte de l'intégration de l'échelle inverse, a une solution de forme fermée, connue sous le nom de distribution gamma composée .

Si à la place le paramètre de forme est connu mais que la moyenne est inconnue, le prior de la moyenne étant donné par une autre distribution gamma, il en résulte une distribution K .

Inférence statistique

Estimation des paramètres

Estimation de vraisemblance maximale

La fonction de vraisemblance pour N observations iid ( x 1 , ..., x N ) est

à partir de laquelle on calcule la fonction de log-vraisemblance

Trouver le maximum par rapport à θ en prenant la dérivée et en la fixant à zéro donne l' estimateur du maximum de vraisemblance du paramètre θ :

En substituant cela à la fonction de log-vraisemblance, on obtient

Trouver le maximum par rapport à k en prenant la dérivée et en la fixant à zéro donne

où est la fonction digamma . Il n'y a pas de solution fermée pour k . La fonction se comporte très bien numériquement, donc si une solution numérique est souhaitée, elle peut être trouvée en utilisant, par exemple, la méthode de Newton . Une valeur initiale de k peut être trouvée soit en utilisant la méthode des moments , soit en utilisant l' approximation

Si nous laissons

alors k est approximativement

qui est à moins de 1,5% de la valeur correcte. Une forme explicite pour la mise à jour Newton-Raphson de cette estimation initiale est :

Estimateurs fermés

Conformément estimateurs de forme fermée de k et θ existe qui sont dérivés de la probabilité de la distribution gamma généralisée .

L'estimation pour la forme k est

et l'estimation de l'échelle θ est

Si le paramétrage du taux est utilisé, l'estimation de .

Ces estimateurs ne sont pas strictement des estimateurs par maximum de vraisemblance, mais sont plutôt appelés estimateurs de type mixte log-moment. Ils ont cependant une efficacité similaire à celle des estimateurs du maximum de vraisemblance.

Bien que ces estimateurs soient cohérents, ils présentent un faible biais. Une variante corrigée biais de l'estimateur à l'échelle θ est

Une correction de biais pour le paramètre de forme k est donnée par

Erreur quadratique moyenne minimale bayésienne

Avec k connu et θ inconnu , la fonction de densité postérieure pour thêta (en utilisant l'invariant d'échelle standard a priori pour θ ) est

Désignant

L'intégration par rapport à θ peut être réalisée à l'aide d'un changement de variables, révélant que 1/ θ est gamma-distribué avec les paramètres α = Nk , β = y .

Les moments peuvent être calculés en prenant le rapport ( m par m = 0)

ce qui montre que l'estimation de la moyenne ± écart type de la distribution a posteriori de θ est

Inférence bayésienne

Conjugué avant

Dans l' inférence bayésienne , la distribution gamma est le conjugué avant de nombreuses distributions de probabilité: le Poisson , exponentielle , normale (avec connue moyenne), Pareto , gamma avec une forme connue σ , gamma inverse avec le paramètre de forme connue, et Gompertz avec le paramètre d'échelle connue.

Le conjugué a priori de la distribution gamma est :

où Z est la constante de normalisation, qui n'a pas de solution fermée. La distribution postérieure peut être trouvée en mettant à jour les paramètres comme suit :

où n est le nombre d'observations et x i est la i ème observation.

Occurrence et applications

La distribution gamma a été utilisée pour modéliser la taille des sinistres et des précipitations. Cela signifie que les réclamations d'assurance globales et la quantité de précipitations accumulées dans un réservoir sont modélisées par un processus gamma - tout comme la distribution exponentielle génère un processus de Poisson .

La distribution gamma est également utilisée pour modéliser les erreurs dans les modèles de régression de Poisson à plusieurs niveaux , car un mélange de distributions de Poisson avec des taux distribués gamma a une distribution de forme fermée connue, appelée binomiale négative .

Dans les communications sans fil, la distribution gamma est utilisée pour modéliser l' évanouissement par trajets multiples de la puissance du signal ; voir aussi la distribution de Rayleigh et la distribution de Rican .

En oncologie , la distribution par âge de l' incidence du cancer suit souvent la distribution gamma, alors que les paramètres de forme et d'échelle prédisent, respectivement, le nombre d' événements conducteurs et l'intervalle de temps entre eux.

En neurosciences , la distribution gamma est souvent utilisée pour décrire la distribution des intervalles inter-pics .

Dans l'expression génique bactérienne , le nombre de copies d'une protéine exprimée de manière constitutive suit souvent la distribution gamma, où l'échelle et le paramètre de forme sont, respectivement, le nombre moyen de bouffées par cycle cellulaire et le nombre moyen de molécules protéiques produites par un seul ARNm pendant sa durée de vie.

En génomique , la distribution gamma a été appliquée à l' étape d' appel de pointe (c'est-à-dire en reconnaissance du signal) dans l' analyse des données ChIP-chip et ChIP-seq .

La distribution gamma est largement utilisée comme a priori conjugué dans les statistiques bayésiennes. C'est le conjugué a priori de la précision (c'est-à-dire l'inverse de la variance) d'une distribution normale . C'est aussi le conjugué a priori de la distribution exponentielle .

Génération de variables aléatoires à distribution gamma

Compte tenu de la propriété d'échelle ci - dessus, il suffit de générer des variables gamma avec θ = 1 comme on peut le convertir en une suite valeur de β avec une simple division.

Supposons que l' on veut générer des variables aléatoires de Gamma ( n + δ , 1), où n est un nombre entier non négatif et 0 < δ <1. En utilisant le fait qu'une distribution Gamma (1, 1) est identique à une Exp (1) distribution, et notant la méthode de génération des variables exponentielles , nous concluons que si U est uniformément distribué sur (0, 1], alors −ln( U ) est distribué Gamma(1, 1) (c'est-à-dire échantillonnage par transformée inverse ). Maintenant, en utilisant la propriété " α -addition" de la distribution gamma, nous développons ce résultat :

où U k sont tous uniformément distribués sur (0, 1] et indépendants . Il ne reste plus qu'à générer une variable distribuée en Gamma( δ , 1) pour 0 < δ < 1 et appliquer la propriété " α -addition" une fois C'est la partie la plus difficile.

La génération aléatoire de variables gamma est discutée en détail par Devroye, notant qu'aucune n'est uniformément rapide pour tous les paramètres de forme. Pour les petites valeurs du paramètre de forme, les algorithmes ne sont souvent pas valides. Pour des valeurs arbitraires du paramètre de forme, on peut appliquer la méthode d'acceptation-rejet modifiée d'Ahrens et Dieter, l'algorithme GD (forme k 1), ou la méthode de transformation lorsque 0 < k < 1. Voir également l'algorithme de Cheng et Feast GKM 3 ou la compression de Marsaglia méthode.

Ce qui suit est une version de la méthode d'acceptation-rejet d' Ahrens-Dieter :

- Générer U , V et W en tant que variables iid uniformes (0, 1].

- Si alors et . Sinon, et .

- Si alors passez à l'étape 1.

- ξ est distribué comme Γ( δ , 1).

Un résumé de ceci est

où est la partie entière de k , ξ est généré via l'algorithme ci-dessus avec δ = { k } (la partie fractionnaire de k ) et les U k sont tous indépendants.

Bien que l'approche ci-dessus soit techniquement correcte, Devroye note qu'elle est linéaire dans la valeur de k et n'est en général pas un bon choix. Au lieu de cela, il recommande d'utiliser des méthodes basées sur le rejet ou basées sur des tableaux, selon le contexte.

Par exemple, la méthode simple de transformation-rejet de Marsaglia reposant sur une variable normale X et une variable uniforme U :

- Réglez et .

- Ensemble .

- Si et retour , sinon retournez à l'étape 2.

With génère un nombre aléatoire distribué gamma dans le temps qui est approximativement constant avec k . Le taux d'acceptation dépend de k , avec un taux d'acceptation de 0,95, 0,98 et 0,99 pour k=1, 2 et 4. Pour k < 1, on peut utiliser pour augmenter k pour être utilisable avec cette méthode.

Remarques

Liens externes

- "Gamma-distribution" , Encyclopédie des mathématiques , EMS Press , 2001 [1994]

- Weisstein, Eric W. "Distribution gamma" . MathWorld .

- ModelAssist (2017) Utilisations de la distribution gamma dans la modélisation des risques, y compris des exemples appliqués dans Excel .

- Manuel de statistiques d'ingénierie

![{\displaystyle k={\frac {E[X]^{2}}{V[X]}}\quad \quad }](https://wikimedia.org/api/rest_v1/media/math/render/svg/79060985aa8683bbf0b380d57ca56522822342ca)

![{\displaystyle \theta ={\frac {V[X]}{E[X]}}\quad \quad }](https://wikimedia.org/api/rest_v1/media/math/render/svg/de7bf8b64325f4129e05929e2385f3ca37bb88bf)

![{\displaystyle \alpha ={\frac {E[X]^{2}}{V[X]}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/87074b8ec525badd064920b64dcff7be1c51ceaa)

![{\displaystyle \beta ={\frac {E[X]}{V[X]}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/187bc571898043026331662ae41bb70d4104d429)

![{\displaystyle {\begin{aligned}f(x;\alpha ,\beta )&={\frac {\beta ^{\alpha }x^{\alpha -1}e^{-\beta x}}{ \Gamma (\alpha )}}\quad {\text{ for }}x>0\quad \alpha ,\beta >0,\\[6pt]\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e17d7cc2f7f0e724776f777dc6552b261fea46fe)

![{\displaystyle \mathrm {E} [X^{n}]=\theta ^{n}{\frac {\Gamma (n+k)}{\Gamma (k)}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/83c5249cc28b4f7b7529ebe80d80a4f7ab8e7afc)

![{\displaystyle \operatorname {E} [\ln(X)]=\psi (\alpha )-\ln(\beta )}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6da14ff7ed563c7e86154998ef6fd180e79c9bfa)

![{\displaystyle \operatorname {E} [\ln(X)]=\psi (k)+\ln(\theta )}](https://wikimedia.org/api/rest_v1/media/math/render/svg/186737f3b184bf00519b3a4b1412a560e1216093)

![{\displaystyle \operatorname {var} [\ln(X)]=\psi ^{(1)}(\alpha )=\psi ^{(1)}(k)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b193ce127d5d0de9a3430b7dc803c092262f7b5c)

![{\displaystyle {\begin{aligned}\operatorname {H} (X)&=\operatorname {E} [-\ln(p(X))]\\[4pt]&=\operatorname {E} [-\ alpha \ln(\beta )+\ln(\Gamma (\alpha ))-(\alpha -1)\ln(X)+\beta X]\\[4pt]&=\alpha -\ln(\beta )+\ln(\Gamma (\alpha ))+(1-\alpha )\psi (\alpha ).\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/37a24251136eb110aea24081dcffb2ee9e9648d8)

![{\displaystyle \operatorname {E} [x^{m}]={\frac {\Gamma (Nk-m)}{\Gamma (Nk)}}y^{m}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/61ae01ae77aa6c640cbaa1bb2a8863454827916a)