Intelligence artificielle -Artificial intelligence

| Partie d'une série sur |

| Intelligence artificielle |

|---|

L'intelligence artificielle ( IA ) est l'intelligence démontrée par les machines , par opposition à l' intelligence naturelle dont font preuve les animaux, y compris les humains . La recherche en IA a été définie comme le domaine d'étude des agents intelligents , qui fait référence à tout système qui perçoit son environnement et entreprend des actions qui maximisent ses chances d'atteindre ses objectifs.

Le terme « intelligence artificielle » était auparavant utilisé pour décrire des machines qui imitent et affichent les compétences cognitives « humaines » associées à l' esprit humain , telles que « l'apprentissage » et la « résolution de problèmes ». Cette définition a depuis été rejetée par les grands chercheurs en IA qui décrivent désormais l'IA en termes de rationalité et d'action rationnelle, ce qui ne limite pas la façon dont l'intelligence peut être articulée.

Les applications d'intelligence artificielle comprennent les moteurs de recherche Web avancés (par exemple, Google ), les systèmes de recommandation (utilisés par YouTube , Amazon et Netflix ), la compréhension de la parole humaine (comme Siri et Alexa ), les voitures autonomes (par exemple Tesla ), la prise de décision automatisée et concourir au plus haut niveau dans les systèmes de jeu stratégiques (comme les échecs et le Go ). À mesure que les machines deviennent de plus en plus performantes, les tâches considérées comme nécessitant de l'"intelligence" sont souvent retirées de la définition de l'IA, un phénomène connu sous le nom d' effet IA . Par exemple, la reconnaissance optique de caractères est souvent exclue des choses considérées comme de l'IA, étant devenue une technologie de routine.

L'intelligence artificielle a été fondée en tant que discipline universitaire en 1956, et dans les années qui ont suivi, elle a connu plusieurs vagues d'optimisme, suivies de déception et de perte de financement (appelées « hiver de l'IA »), suivies de nouvelles approches, de succès et de financement renouvelé. . La recherche sur l'IA a essayé et rejeté de nombreuses approches différentes depuis sa création, notamment la simulation du cerveau, la modélisation de la résolution de problèmes humains , la logique formelle , de grandes bases de données de connaissances et l'imitation du comportement animal. Au cours des premières décennies du 21e siècle, l' apprentissage automatique hautement mathématique et statistique a dominé le domaine, et cette technique s'est avérée très efficace, aidant à résoudre de nombreux problèmes difficiles dans l'industrie et le milieu universitaire.

Les différents sous-domaines de la recherche en IA sont centrés sur des objectifs particuliers et l'utilisation d'outils particuliers. Les objectifs traditionnels de la recherche en IA comprennent le raisonnement , la représentation des connaissances , la planification , l'apprentissage , le traitement du langage naturel , la perception et la capacité de déplacer et de manipuler des objets. L'intelligence générale (la capacité à résoudre un problème arbitraire) fait partie des objectifs à long terme du domaine. Pour résoudre ces problèmes, les chercheurs en intelligence artificielle ont adapté et intégré un large éventail de techniques de résolution de problèmes, notamment la recherche et l'optimisation mathématique, la logique formelle, les réseaux de neurones artificiels et les méthodes basées sur les statistiques , les probabilités et l'économie . L'IA s'appuie également sur l'informatique , la psychologie , la linguistique , la philosophie et bien d'autres domaines.

Le domaine a été fondé sur l'hypothèse que l'intelligence humaine "peut être décrite avec une telle précision qu'une machine peut être conçue pour la simuler". Cela a soulevé des arguments philosophiques sur l'esprit et les conséquences éthiques de la création d'êtres artificiels dotés d'une intelligence de type humain; ces questions ont déjà été explorées par le mythe , la fiction et la philosophie depuis l'antiquité. Des informaticiens et des philosophes ont depuis suggéré que l'IA pourrait devenir un risque existentiel pour l'humanité si ses capacités rationnelles ne sont pas orientées vers des objectifs bénéfiques.

Histoire

Fictions et premiers concepts

Les êtres artificiels dotés d'intelligence sont apparus comme des dispositifs de narration dans l'Antiquité et ont été courants dans la fiction, comme dans Frankenstein de Mary Shelley ou RUR de Karel Čapek . Ces personnages et leurs destins ont soulevé bon nombre des mêmes problèmes que l' éthique de l'intelligence artificielle . .

L'étude du raisonnement mécanique ou « formel » a commencé avec les philosophes et les mathématiciens dans l'Antiquité. L'étude de la logique mathématique a conduit directement à la théorie du calcul d' Alan Turing , qui suggérait qu'une machine, en mélangeant des symboles aussi simples que "0" et "1", pouvait simuler n'importe quel acte concevable de déduction mathématique. Cette idée que les ordinateurs numériques peuvent simuler n'importe quel processus de raisonnement formel est connue sous le nom de thèse de Church-Turing .

La thèse de Church-Turing, ainsi que des découvertes concomitantes en neurobiologie , en théorie de l'information et en cybernétique , ont conduit les chercheurs à envisager la possibilité de construire un cerveau électronique. Le premier travail qui est maintenant généralement reconnu comme IA était la conception formelle de 1943 de McCullouch et Pitts pour les "neurones artificiels" complets de Turing .

Premières recherches

Dans les années 1950, deux visions sur la manière d'atteindre l'intelligence artificielle ont émergé. Une vision, connue sous le nom d' IA symbolique ou GOFAI , consistait à utiliser des ordinateurs pour créer une représentation symbolique du monde et des systèmes capables de raisonner sur le monde. Les partisans comprenaient Allen Newell , Herbert A. Simon et Marvin Minsky . Étroitement associée à cette approche était l'approche de «recherche heuristique» , qui assimilait l'intelligence à un problème d'exploration d'un espace de possibilités de réponses. La deuxième vision, connue sous le nom d' approche connexionniste , cherchait à atteindre l'intelligence par l'apprentissage. Les partisans de cette approche, notamment Frank Rosenblatt , ont cherché à connecter Perceptron de manière inspirée par les connexions des neurones. James Manyika et d'autres ont comparé les deux approches de l'esprit (IA symbolique) et du cerveau (connexionniste). Manyika soutient que les approches symboliques ont dominé la poussée de l'intelligence artificielle à cette époque, en partie en raison de son lien avec les traditions intellectuelles de Descarte , Boole , Gottlob Frege , Bertrand Russell et d'autres. Les approches connexionnistes basées sur la cybernétique ou les réseaux de neurones artificiels ont été repoussées au second plan mais ont acquis une nouvelle importance au cours des dernières décennies.

Le domaine de la recherche sur l'IA est né lors d' un atelier au Dartmouth College en 1956. Les participants sont devenus les fondateurs et les leaders de la recherche sur l'IA. Eux et leurs élèves produisirent des programmes que la presse qualifia d'"étonnants": des ordinateurs apprenaient des stratégies de jeu de dames , résolvaient des problèmes de mots en algèbre, prouvaient des théorèmes logiques et parlaient anglais. Au milieu des années 1960, la recherche aux États-Unis était fortement financée par le ministère de la Défense et des laboratoires avaient été créés dans le monde entier.

Les chercheurs des années 1960 et 1970 étaient convaincus que les approches symboliques finiraient par réussir à créer une machine dotée d'une intelligence artificielle générale et considéraient cela comme l'objectif de leur domaine. Herbert Simon a prédit que "les machines seront capables, d'ici vingt ans, de faire n'importe quel travail qu'un homme peut faire". Marvin Minsky a accepté, écrivant, "d'ici une génération ... le problème de la création de 'l'intelligence artificielle' sera en grande partie résolu".

Ils n'ont pas reconnu la difficulté de certaines des tâches restantes. Les progrès ont ralenti et en 1974, en réponse aux critiques de Sir James Lighthill et à la pression continue du Congrès américain pour financer des projets plus productifs , les gouvernements américain et britannique ont interrompu la recherche exploratoire en IA. Les années suivantes seront plus tard appelées un « hiver de l'IA », une période où l'obtention de financements pour des projets d'IA était difficile.

Des systèmes experts à l'apprentissage automatique

Au début des années 1980, la recherche sur l'IA a été relancée par le succès commercial des systèmes experts , une forme de programme d'IA qui simulait les connaissances et les compétences analytiques d'experts humains. En 1985, le marché de l'IA avait atteint plus d'un milliard de dollars. Dans le même temps, le projet informatique de cinquième génération du Japon a inspiré les gouvernements américain et britannique à rétablir le financement de la recherche universitaire . Cependant, à partir de l'effondrement du marché des machines Lisp en 1987, l'IA est à nouveau tombée dans le discrédit et un deuxième hiver plus long a commencé.

De nombreux chercheurs ont commencé à douter que l' approche symbolique serait capable d'imiter tous les processus de la cognition humaine, en particulier la perception , la robotique, l'apprentissage et la reconnaissance des formes . Un certain nombre de chercheurs ont commencé à se pencher sur des approches "sous-symboliques" de problèmes spécifiques d'IA. Les chercheurs en robotique , tels que Rodney Brooks , ont rejeté l'IA symbolique et se sont concentrés sur les problèmes d'ingénierie de base qui permettraient aux robots de se déplacer, de survivre et d'apprendre leur environnement. L'intérêt pour les réseaux de neurones et le « connexionnisme » a été ravivé par Geoffrey Hinton , David Rumelhart et d'autres au milieu des années 1980. Des outils informatiques souples ont été développés dans les années 80, tels que les réseaux de neurones , les systèmes flous , la théorie des systèmes de Gray , le calcul évolutionnaire et de nombreux outils tirés des statistiques ou de l'optimisation mathématique .

L'IA a progressivement restauré sa réputation à la fin des années 1990 et au début du 21e siècle en trouvant des solutions spécifiques à des problèmes spécifiques. La focalisation étroite a permis aux chercheurs de produire des résultats vérifiables, d'exploiter davantage de méthodes mathématiques et de collaborer avec d'autres domaines (tels que les statistiques , l'économie et les mathématiques ). En 2000, les solutions développées par les chercheurs en IA étaient largement utilisées, même si dans les années 1990, elles étaient rarement qualifiées d'"intelligence artificielle".

Des ordinateurs plus rapides , des améliorations algorithmiques et l'accès à de grandes quantités de données ont permis des avancées dans l'apprentissage automatique et la perception ; les méthodes d' apprentissage en profondeur gourmandes en données ont commencé à dominer les critères de précision vers 2012 . Selon Jack Clark de Bloomberg , 2015 a été une année charnière pour l'intelligence artificielle, le nombre de projets logiciels utilisant l'IA au sein de Google est passé d'une "utilisation sporadique" en 2012 à plus de 2 700 projets. Il attribue cela à une augmentation des réseaux de neurones abordables , due à une augmentation de l'infrastructure de cloud computing et à une augmentation des outils de recherche et des ensembles de données. Dans une enquête de 2017, une entreprise sur cinq a déclaré avoir "intégré l'IA dans certaines offres ou certains processus". Le volume de recherche sur l'IA (mesuré par le nombre total de publications) a augmenté de 50 % entre 2015 et 2019.

De nombreux chercheurs universitaires se sont inquiétés du fait que l'IA ne poursuivait plus l'objectif initial de créer des machines polyvalentes et entièrement intelligentes. Une grande partie de la recherche actuelle implique l'IA statistique, qui est massivement utilisée pour résoudre des problèmes spécifiques, même des techniques très efficaces telles que l'apprentissage en profondeur . Cette préoccupation a conduit au sous-domaine de l'intelligence artificielle générale (ou «AGI»), qui comptait plusieurs institutions bien financées dans les années 2010.

Buts

Le problème général de la simulation (ou de la création) de l'intelligence a été décomposé en sous-problèmes. Il s'agit de caractéristiques ou de capacités particulières que les chercheurs attendent d'un système intelligent. Les traits décrits ci-dessous ont reçu le plus d'attention.

Raisonnement, résolution de problèmes

Les premiers chercheurs ont développé des algorithmes qui imitaient le raisonnement étape par étape que les humains utilisent lorsqu'ils résolvent des énigmes ou font des déductions logiques. À la fin des années 1980 et dans les années 1990, la recherche sur l'IA avait développé des méthodes pour traiter les informations incertaines ou incomplètes, en utilisant des concepts de probabilité et d'économie .

Beaucoup de ces algorithmes se sont avérés insuffisants pour résoudre de gros problèmes de raisonnement car ils ont connu une "explosion combinatoire": ils sont devenus exponentiellement plus lents à mesure que les problèmes grandissaient. Même les humains utilisent rarement la déduction étape par étape que les premières recherches sur l'IA pourraient modéliser. Ils résolvent la plupart de leurs problèmes en utilisant des jugements rapides et intuitifs.

Représentation des connaissances

La représentation des connaissances et l'ingénierie des connaissances permettent aux programmes d'IA de répondre intelligemment aux questions et de faire des déductions sur des faits réels.

Une représentation de « ce qui existe » est une ontologie : l'ensemble des objets, relations, concepts et propriétés formellement décrits pour que les agents logiciels puissent les interpréter. Les ontologies les plus générales sont appelées ontologies supérieures , qui tentent de fournir une base pour toutes les autres connaissances et agissent comme médiateurs entre les ontologies de domaine qui couvrent des connaissances spécifiques sur un domaine de connaissances particulier (domaine d'intérêt ou domaine de préoccupation). Un programme vraiment intelligent aurait également besoin d'accéder à des connaissances de bon sens ; l'ensemble des faits qu'une personne moyenne connaît. La sémantique d'une ontologie est généralement représentée dans une logique de description, telle que le Web Ontology Language .

La recherche en IA a développé des outils pour représenter des domaines spécifiques, tels que des objets, des propriétés, des catégories et des relations entre objets ; situations, événements, états et temps; causes et effets; connaissance sur la connaissance (ce que nous savons sur ce que les autres savent) ;. raisonnement par défaut (les choses que les humains supposent être vraies jusqu'à ce qu'elles soient dites différemment et resteront vraies même lorsque d'autres faits changent); ainsi que d'autres domaines. Parmi les problèmes les plus difficiles de l'IA figurent : l'étendue des connaissances de bon sens (le nombre de faits atomiques que la personne moyenne connaît est énorme) ; et la forme sous-symbolique de la plupart des connaissances de sens commun (une grande partie de ce que les gens savent n'est pas représentée comme des "faits" ou des "déclarations" qu'ils pourraient exprimer verbalement).

Les représentations formelles des connaissances sont utilisées dans l'indexation et la récupération basées sur le contenu, l'interprétation de scènes, l'aide à la décision clinique, la découverte de connaissances (extraction d'inférences "intéressantes" et exploitables à partir de grandes bases de données) et d'autres domaines.

Planification

Un agent intelligent qui peut planifier fait une représentation de l'état du monde, fait des prédictions sur la façon dont ses actions vont le changer et fait des choix qui maximisent l' utilité (ou la « valeur ») des choix disponibles. Dans les problèmes de planification classiques, l'agent peut supposer qu'il s'agit du seul système agissant dans le monde, ce qui lui permet d'être certain des conséquences de ses actions. Cependant, si l'agent n'est pas le seul acteur, il faut alors que l'agent raisonne dans l'incertitude, réévalue continuellement son environnement et s'adapte. La planification multi-agents utilise la coopération et la concurrence de nombreux agents pour atteindre un objectif donné. Un tel comportement émergent est utilisé par les algorithmes évolutionnaires et l'intelligence en essaim .

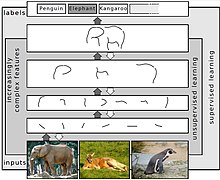

Apprentissage

L'apprentissage automatique (ML), un concept fondamental de la recherche en IA depuis la création du domaine, est l'étude d'algorithmes informatiques qui s'améliorent automatiquement grâce à l'expérience.

L'apprentissage non supervisé trouve des modèles dans un flux d'entrées. L'apprentissage supervisé nécessite qu'un humain étiquette d'abord les données d'entrée et se présente sous deux formes principales : la classification et la régression numérique . La classification est utilisée pour déterminer à quelle catégorie quelque chose appartient - le programme voit un certain nombre d'exemples de choses de plusieurs catégories et apprendra à classer les nouvelles entrées. La régression est la tentative de produire une fonction qui décrit la relation entre les entrées et les sorties et prédit comment les sorties devraient changer à mesure que les entrées changent. Les classificateurs et les apprenants de régression peuvent être considérés comme des « approximateurs de fonction » essayant d'apprendre une fonction inconnue (éventuellement implicite) ; par exemple, un classificateur de spam peut être considéré comme apprenant une fonction qui fait correspondre le texte d'un e-mail à l'une des deux catégories, "spam" ou "pas de spam". Dans l' apprentissage par renforcement, l'agent est récompensé pour les bonnes réponses et puni pour les mauvaises. L'agent classe ses réponses pour former une stratégie d'opération dans son espace de problèmes. L' apprentissage par transfert consiste à appliquer les connaissances acquises à partir d'un problème à un nouveau problème.

La théorie de l'apprentissage informatique peut évaluer les apprenants en fonction de la complexité informatique , de la complexité de l'échantillon (la quantité de données requise) ou d'autres notions d' optimisation .

Traitement du langage naturel

Le traitement du langage naturel (NLP) permet aux machines de lire et de comprendre le langage humain. Un système de traitement du langage naturel suffisamment puissant permettrait des interfaces utilisateur en langage naturel et l'acquisition de connaissances directement à partir de sources écrites par l'homme, telles que les textes des fils de presse. Certaines applications simples de la PNL incluent la recherche d' informations , la réponse aux questions et la traduction automatique .

L'IA symbolique a utilisé une syntaxe formelle pour traduire la structure profonde des phrases en logique . Cela n'a pas produit d'applications utiles, en raison de l' indocilité de la logique et de l'étendue des connaissances de bon sens. Les techniques statistiques modernes incluent les fréquences de cooccurrence (la fréquence à laquelle un mot apparaît près d'un autre), la "recherche de mots-clés" (recherche d'un mot particulier pour récupérer des informations), l'apprentissage en profondeur basé sur les transformateurs (qui trouve des modèles dans le texte), etc. Ils ont atteint une précision acceptable au niveau de la page ou du paragraphe et, d'ici 2019, pourraient générer un texte cohérent.

Perception

La perception de la machine est la capacité d'utiliser les entrées de capteurs (tels que des caméras, des microphones, des signaux sans fil et des capteurs lidar , sonar, radar et tactiles actifs ) pour déduire des aspects du monde. Les applications incluent la reconnaissance vocale , la reconnaissance faciale et la reconnaissance d' objets . La vision par ordinateur est la capacité d'analyser les données visuelles.

Mouvement et manipulation

L'IA est largement utilisée en robotique. La localisation est la façon dont un robot connaît son emplacement et cartographie son environnement. Lorsqu'on leur donne un petit environnement statique et visible, c'est facile ; cependant, les environnements dynamiques, tels que (en endoscopie ) l'intérieur du corps respiratoire d'un patient, posent un plus grand défi.

La planification des mouvements est le processus de décomposition d'une tâche de mouvement en "primitives" telles que les mouvements articulaires individuels. Un tel mouvement implique souvent un mouvement conforme, un processus où le mouvement nécessite de maintenir un contact physique avec un objet. Les robots peuvent apprendre par expérience à se déplacer efficacement malgré la présence de frottements et de patinages.

Intelligence sociale

L'informatique affective est un parapluie interdisciplinaire qui comprend des systèmes qui reconnaissent, interprètent, traitent ou simulent les sentiments, les émotions et l'humeur humains . Par exemple, certains assistants virtuels sont programmés pour parler de manière conversationnelle ou même pour plaisanter avec humour ; cela les fait apparaître plus sensibles à la dynamique émotionnelle de l'interaction humaine, ou pour faciliter autrement l'interaction homme-ordinateur . Cependant, cela tend à donner aux utilisateurs naïfs une conception irréaliste de l'intelligence réelle des agents informatiques existants. Les succès modérés liés à l'informatique affective incluent l' analyse textuelle des sentiments et, plus récemment, l'analyse multimodale des sentiments ), dans laquelle l'IA classe les affects affichés par un sujet filmé.

Intelligence générale

Une machine dotée d'une intelligence générale peut résoudre une grande variété de problèmes avec une ampleur et une polyvalence similaires à l'intelligence humaine. Il existe plusieurs idées concurrentes sur la façon de développer l'intelligence artificielle générale. Hans Moravec et Marvin Minsky soutiennent que le travail dans différents domaines individuels peut être intégré dans un système multi-agent avancé ou une architecture cognitive avec une intelligence générale. Pedro Domingos espère qu'il existe un « algorithme principal » conceptuellement simple, mais mathématiquement difficile, qui pourrait conduire à l'IAG. D'autres croient que les caractéristiques anthropomorphiques comme un cerveau artificiel ou le développement simulé de l'enfant atteindront un jour un point critique où l'intelligence générale émergera .

Outils

Recherche et optimisation

De nombreux problèmes en IA peuvent être résolus théoriquement en recherchant intelligemment parmi de nombreuses solutions possibles : Le raisonnement peut être réduit à effectuer une recherche. Par exemple, la preuve logique peut être considérée comme la recherche d'un chemin qui mène des prémisses aux conclusions , où chaque étape est l'application d'une règle d'inférence . Les algorithmes de planification recherchent dans des arbres d'objectifs et de sous-objectifs, essayant de trouver un chemin vers un objectif cible, un processus appelé analyse des moyens et des fins . Les algorithmes robotiques pour déplacer les membres et saisir des objets utilisent des recherches locales dans l'espace de configuration .

De simples recherches exhaustives sont rarement suffisantes pour la plupart des problèmes du monde réel : l' espace de recherche (le nombre d'endroits à rechercher) atteint rapidement des nombres astronomiques . Le résultat est une recherche trop lente ou qui ne se termine jamais. La solution, pour de nombreux problèmes, est d'utiliser des « heuristiques » ou des « règles empiriques » qui priorisent les choix en faveur de ceux qui sont les plus susceptibles d'atteindre un objectif et de le faire en un nombre d'étapes plus court. Dans certaines méthodologies de recherche, l'heuristique peut également servir à éliminer certains choix peu susceptibles de mener à un but (ce que l'on appelle « l' élagage de l' arbre de recherche »). L'heuristique fournit au programme une "meilleure estimation" du chemin sur lequel se trouve la solution. L'heuristique limite la recherche de solutions à un échantillon de plus petite taille.

Un type de recherche très différent a pris de l'importance dans les années 1990, basé sur la théorie mathématique de l' optimisation . Pour de nombreux problèmes, il est possible de commencer la recherche avec une certaine forme d'estimation, puis d'affiner progressivement l'estimation jusqu'à ce qu'il n'y ait plus d'améliorations possibles. Ces algorithmes peuvent être visualisés comme de l' escalade à l'aveugle : nous commençons la recherche à un point aléatoire du paysage, puis, par sauts ou marches, nous continuons à déplacer notre supposition vers le haut, jusqu'à ce que nous atteignions le sommet. D' autres algorithmes d' optimisation associés incluent l' optimisation aléatoire , la recherche de faisceaux et les métaheuristiques comme le recuit simulé . Le calcul évolutionnaire utilise une forme de recherche d'optimisation. Par exemple, ils peuvent commencer avec une population d'organismes (les suppositions), puis leur permettre de muter et de se recombiner, en sélectionnant uniquement les plus aptes à survivre à chaque génération (en affinant les suppositions). Les algorithmes évolutionnaires classiques incluent les algorithmes génétiques , la programmation de l' expression génique et la programmation génétique . Alternativement, les processus de recherche distribués peuvent se coordonner via des algorithmes d'intelligence en essaim . Deux algorithmes d'essaims populaires utilisés dans la recherche sont l'optimisation des essaims de particules (inspirée du flocage d'oiseaux ) et l' optimisation des colonies de fourmis (inspirée des pistes de fourmis ).

Logique

La logique est utilisée pour la représentation des connaissances et la résolution de problèmes, mais elle peut également être appliquée à d'autres problèmes. Par exemple, l' algorithme satplan utilise la logique pour la planification et la programmation logique inductive est une méthode d' apprentissage .

Plusieurs formes différentes de logique sont utilisées dans la recherche en IA. La logique propositionnelle implique des fonctions de vérité telles que "ou" et "non". La logique du premier ordre ajoute des quantificateurs et des prédicats et peut exprimer des faits sur les objets, leurs propriétés et leurs relations les uns avec les autres. La logique floue attribue un "degré de vérité" (entre 0 et 1) à des déclarations vagues telles que "Alice est vieille" (ou riche, ou grande, ou affamée), qui sont trop imprécises linguistiquement pour être complètement vraies ou fausses. Les logiques par défaut , les logiques non monotones et la circonscription sont des formes de logique conçues pour aider au raisonnement par défaut et au problème de qualification . Plusieurs extensions de la logique ont été conçues pour gérer des domaines de connaissance spécifiques , tels que les logiques de description ; calcul de situation, calcul d' événement et calcul fluent (pour représenter les événements et le temps); calcul causal ; calcul de croyance (révision de croyance) ; et les logiques modales . Des logiques pour modéliser des déclarations contradictoires ou incohérentes survenant dans des systèmes multi-agents ont également été conçues, telles que des logiques paracohérentes .

Méthodes probabilistes pour raisonnement incertain

De nombreux problèmes d'IA (y compris dans le raisonnement, la planification, l'apprentissage, la perception et la robotique) obligent l'agent à opérer avec des informations incomplètes ou incertaines. Les chercheurs en IA ont conçu un certain nombre d'outils pour résoudre ces problèmes en utilisant des méthodes issues de la théorie des probabilités et de l'économie. Les réseaux bayésiens sont un outil très général qui peut être utilisé pour divers problèmes, notamment le raisonnement (à l'aide de l' algorithme d' inférence bayésien ), l'apprentissage (à l'aide de l' algorithme d'attente-maximisation ), la planification (à l'aide de réseaux de décision ) et la perception (à l'aide de réseaux bayésiens dynamiques ). Les algorithmes probabilistes peuvent également être utilisés pour filtrer, prédire, lisser et trouver des explications pour les flux de données, aidant les systèmes de perception à analyser les processus qui se produisent au fil du temps (par exemple, les modèles de Markov cachés ou les filtres de Kalman ).

Un concept clé de la science économique est " l'utilité ", une mesure de la valeur d'une chose pour un agent intelligent. Des outils mathématiques précis ont été développés pour analyser comment un agent peut faire des choix et planifier, en utilisant la théorie de la décision , l'analyse de la décision et la théorie de la valeur de l'information. Ces outils incluent des modèles tels que les processus décisionnels de Markov , les réseaux de décision dynamiques , la théorie des jeux et la conception de mécanismes .

Classificateurs et méthodes d'apprentissage statistique

Les applications d'IA les plus simples peuvent être divisées en deux types : les classificateurs ("si brillant alors diamant") et les contrôleurs ("si diamant alors ramasser"). Cependant, les contrôleurs classent également les conditions avant de déduire des actions, et par conséquent la classification constitue un élément central de nombreux systèmes d'IA. Les classificateurs sont des fonctions qui utilisent la correspondance de modèles pour déterminer la correspondance la plus proche. Ils peuvent être ajustés en fonction d'exemples, ce qui les rend très attrayants pour une utilisation en IA. Ces exemples sont connus sous le nom d'observations ou de modèles. Dans l'apprentissage supervisé, chaque modèle appartient à une certaine classe prédéfinie. Une classe est une décision qui doit être prise. Toutes les observations combinées avec leurs étiquettes de classe constituent un ensemble de données. Lorsqu'une nouvelle observation est reçue, cette observation est classée en fonction de l'expérience précédente.

Un classifieur peut être entraîné de différentes manières ; il existe de nombreuses approches statistiques et d'apprentissage automatique . L' arbre de décision est l'algorithme d'apprentissage automatique symbolique le plus simple et le plus largement utilisé. L' algorithme K-plus proche voisin était l'IA analogique la plus largement utilisée jusqu'au milieu des années 1990. Les méthodes de noyau telles que la machine à vecteurs de support (SVM) ont déplacé le k plus proche voisin dans les années 1990. Le classificateur naïf de Bayes serait "l'apprenant le plus utilisé" chez Google, en partie à cause de son évolutivité. Les réseaux de neurones sont également utilisés pour la classification.

Les performances du classifieur dépendent fortement des caractéristiques des données à classer, telles que la taille de l'ensemble de données, la distribution des échantillons entre les classes, la dimensionnalité et le niveau de bruit. Les classificateurs basés sur un modèle fonctionnent bien si le modèle supposé correspond extrêmement bien aux données réelles. Sinon, si aucun modèle correspondant n'est disponible, et si la précision (plutôt que la vitesse ou l'évolutivité) est la seule préoccupation, la sagesse conventionnelle est que les classificateurs discriminants (en particulier SVM) ont tendance à être plus précis que les classificateurs basés sur un modèle tels que "naïf Bayes" sur la plupart des ensembles de données pratiques.

Réseaux de neurones artificiels

Les réseaux de neurones se sont inspirés de l'architecture des neurones du cerveau humain. Un simple "neurone" N accepte les entrées d'autres neurones, chacun d'eux, lorsqu'il est activé (ou "activé"), émet un "vote" pondéré pour ou contre l'activation du neurone N lui-même. L'apprentissage nécessite un algorithme pour ajuster ces pondérations en fonction des données d'apprentissage ; un algorithme simple (surnommé « tirer ensemble, câbler ensemble ») consiste à augmenter le poids entre deux neurones connectés lorsque l'activation de l'un déclenche l'activation réussie de l'autre. Les neurones ont un spectre continu d'activation ; de plus, les neurones peuvent traiter les entrées de manière non linéaire plutôt que de peser des votes directs.

Les réseaux de neurones modernes modélisent des relations complexes entre les entrées et les sorties et trouvent des modèles dans les données. Ils peuvent apprendre des fonctions continues et même des opérations logiques numériques. Les réseaux de neurones peuvent être considérés comme un type d' optimisation mathématique - ils effectuent une descente de gradient sur une topologie multidimensionnelle qui a été créée en entraînant le réseau. La technique d'entraînement la plus courante est l' algorithme de rétropropagation . D'autres techniques d' apprentissage pour les réseaux de neurones sont l'apprentissage hebbien ("fire together, wire together"), le GMDH ou l'apprentissage compétitif .

Les principales catégories de réseaux sont les réseaux de neurones acycliques ou à réaction (où le signal passe dans une seule direction) et les réseaux de neurones récurrents (qui permettent une rétroaction et des mémoires à court terme des événements d'entrée précédents). Parmi les réseaux prédictifs les plus populaires figurent les perceptrons , les perceptrons multicouches et les réseaux à base radiale .

L'apprentissage en profondeur

L'apprentissage en profondeur utilise plusieurs couches de neurones entre les entrées et les sorties du réseau. Les multiples couches peuvent progressivement extraire des fonctionnalités de niveau supérieur à partir de l'entrée brute. Par exemple, dans le traitement d'image , les couches inférieures peuvent identifier les bords, tandis que les couches supérieures peuvent identifier les concepts pertinents pour un être humain, tels que les chiffres, les lettres ou les visages. L'apprentissage en profondeur a considérablement amélioré les performances des programmes dans de nombreux sous-domaines importants de l'intelligence artificielle, notamment la vision par ordinateur , la reconnaissance vocale , la classification des images et autres.

L'apprentissage en profondeur utilise souvent des réseaux de neurones convolutifs pour plusieurs ou toutes ses couches. Dans une couche convolutive, chaque neurone ne reçoit d'entrée que d'une zone restreinte de la couche précédente appelée champ récepteur du neurone . Cela peut réduire considérablement le nombre de connexions pondérées entre les neurones et créer une hiérarchie similaire à l'organisation du cortex visuel animal.

Dans un réseau neuronal récurrent, le signal se propagera à travers une couche plus d'une fois ; ainsi, un RNN est un exemple d'apprentissage en profondeur. Les RNN peuvent être formés par descente de gradient , mais les gradients à long terme qui sont rétropropagés peuvent "disparaître" (c'est-à-dire qu'ils peuvent tendre vers zéro) ou "exploser" (c'est-à-dire qu'ils peuvent tendre vers l'infini), connu sous le nom de problème de gradient de fuite . La technique de la mémoire à long court terme (LSTM) peut empêcher cela dans la plupart des cas.

Langages et matériel spécialisés

Des langages spécialisés pour l'intelligence artificielle ont été développés, tels que Lisp , Prolog , TensorFlow et bien d'autres. Le matériel développé pour l'IA comprend des accélérateurs d'IA et l'informatique neuromorphique .

Applications

L'IA est pertinente pour toute tâche intellectuelle. Les techniques modernes d'intelligence artificielle sont omniprésentes et trop nombreuses pour être énumérées ici. Souvent, lorsqu'une technique atteint l'usage courant, elle n'est plus considérée comme de l'intelligence artificielle ; ce phénomène est décrit comme l' effet AI .

Dans les années 2010, les applications d'IA étaient au cœur des domaines informatiques les plus prospères sur le plan commercial et sont devenues une caractéristique omniprésente de la vie quotidienne. L'IA est utilisée dans les moteurs de recherche (tels que Google Search ), le ciblage des publicités en ligne , les systèmes de recommandation (offerts par Netflix , YouTube ou Amazon ), la génération de trafic Internet , la publicité ciblée ( AdSense , Facebook ), les assistants virtuels (tels que Siri ou Alexa ) , véhicules autonomes (y compris les drones et les voitures autonomes ), traduction automatique de la langue ( Microsoft Translator , Google Translate ), reconnaissance faciale ( Apple 's Face ID ou Microsoft ' s DeepFace ), étiquetage d'image (utilisé par Facebook , Apple iPhoto et TikTok ) et filtrage anti- spam .

Il existe également des milliers d'applications d'IA réussies utilisées pour résoudre des problèmes pour des industries ou des institutions spécifiques. Quelques exemples sont le stockage d'énergie , les deepfakes , le diagnostic médical, la logistique militaire ou la gestion de la chaîne d'approvisionnement.

Le jeu est un test de la force de l'IA depuis les années 1950. Deep Blue est devenu le premier système informatique de jeu d'échecs à battre un champion du monde d'échecs en titre, Garry Kasparov , le 11 mai 1997. En 2011, in a Jeopardy ! match d'exposition de quiz , le système de réponse aux questions d' IBM , Watson , a vaincu les deux plus grands Jeopardy ! champions, Brad Rutter et Ken Jennings , par une marge significative. En mars 2016, AlphaGo a remporté 4 parties de Go sur 5 dans un match avec le champion de Go Lee Sedol , devenant ainsi le premier système de jeu de Go sur ordinateur à battre un joueur de Go professionnel sans handicap . D'autres programmes gèrent des jeux d'informations imparfaites ; comme pour le poker à un niveau surhumain, Pluribus et Cepheus . DeepMind dans les années 2010 a développé une "intelligence artificielle généralisée" qui pouvait apprendre par elle-même de nombreux jeux Atari divers .

En 2020, les systèmes de traitement du langage naturel tels que l'énorme GPT-3 (alors de loin le plus grand réseau de neurones artificiels) correspondaient aux performances humaines sur des références préexistantes, mais sans que le système n'atteigne une compréhension de bon sens du contenu des références. L' AlphaFold 2 (2020) de DeepMind a démontré la capacité d'approximer, en heures plutôt qu'en mois, la structure 3D d'une protéine. D'autres applications prédisent le résultat de décisions judiciaires, créent de l'art (comme la poésie ou la peinture) et prouvent des théorèmes mathématiques .

En 2019, l'OMPI a signalé que l'IA était la technologie émergente la plus prolifique en termes de nombre de demandes de brevets et de brevets délivrés, l' Internet des objets étant estimé être le plus important en termes de taille de marché. Elle a été suivie, toujours en taille de marché, par les technologies du big data, la robotique, l'IA, l'impression 3D et la cinquième génération de services mobiles (5G). Depuis l'émergence de l'IA dans les années 1950, 340 000 demandes de brevet liées à l'IA ont été déposées par des innovateurs et 1,6 million d'articles scientifiques ont été publiés par des chercheurs, la majorité de tous les dépôts de brevets liés à l'IA ayant été publiés depuis 2013. Les entreprises représentent 26 des 30 premières. Les demandeurs de brevet d'IA, les universités ou les organismes de recherche publics représentant les quatre autres. Le ratio articles scientifiques/inventions a considérablement diminué, passant de 8:1 en 2010 à 3:1 en 2016, ce qui est considéré comme révélateur d'un passage de la recherche théorique à l'utilisation des technologies d'IA dans les produits et services commerciaux. L' apprentissage automatique est la technique d'IA dominante divulguée dans les brevets et est incluse dans plus d'un tiers de toutes les inventions identifiées (134777 brevets d'apprentissage automatique déposés pour un total de 167038 brevets d'IA déposés en 2016), la vision par ordinateur étant l'application fonctionnelle la plus populaire. . Les brevets liés à l'IA ne divulguent pas seulement des techniques et des applications d'IA, ils font souvent également référence à un domaine d'application ou à une industrie. Vingt domaines d'application ont été identifiés en 2016 et comprenaient, par ordre d'importance : les télécommunications (15 %), les transports (15 %), les sciences de la vie et médicales (12 %), et les appareils personnels, l'informatique et l'interaction homme-machine (11 %). . Les autres secteurs comprenaient la banque, le divertissement, la sécurité, l'industrie et la fabrication, l'agriculture et les réseaux (y compris les réseaux sociaux, les villes intelligentes et l'Internet des objets). IBM possède le plus grand portefeuille de brevets d'IA avec 8 290 demandes de brevet, suivi de Microsoft avec 5 930 demandes de brevet.

Les aspects légaux

Les capacités de prise de décision de l'IA soulèvent les questions de la responsabilité légale et du statut du droit d'auteur des œuvres créées. Ces questions sont affinées dans diverses juridictions.

Philosophie

Définir l'intelligence artificielle

Penser contre agir : le test de Turing

Alan Turing écrivait en 1950 "Je propose de considérer la question 'les machines peuvent-elles penser'?" Il a conseillé de changer la question de savoir si une machine "pense" à "si oui ou non il est possible pour une machine de montrer un comportement intelligent". La seule chose visible est le comportement de la machine, donc peu importe si la machine est consciente , ou a un esprit , ou si l'intelligence est simplement une "simulation" et non "la chose réelle". Il a noté que nous ne savons pas non plus ces choses sur les autres, mais que nous étendons une "convention polie" qu'ils "pensent" réellement. Cette idée est à la base du test de Turing.

Agir humainement vs. agir intelligemment : agents intelligents

Le fondateur de l'IA, John McCarthy , a déclaré : "L'intelligence artificielle n'est pas, par définition, une simulation de l'intelligence humaine". Russell et Norvig sont d'accord et critiquent le test de Turing. Ils ont écrit : " Les textes d'ingénierie aéronautique ne définissent pas l'objectif de leur domaine comme étant de fabriquer " des machines qui volent si exactement comme des pigeons qu'elles peuvent tromper d'autres pigeons ". " D'autres chercheurs et analystes ne sont pas d'accord et ont soutenu que l'IA devrait simuler l'intelligence naturelle en étudiant psychologie ou neurobiologie .

Le paradigme de l'agent intelligent définit le comportement intelligent en général, sans référence aux êtres humains. Un agent intelligent est un système qui perçoit son environnement et prend des mesures qui maximisent ses chances de succès. Tout système qui a un comportement orienté vers un but peut être analysé comme un agent intelligent : quelque chose d'aussi simple qu'un thermostat, aussi complexe qu'un être humain, ainsi que de grands systèmes tels que des entreprises , des biomes ou des nations . Le paradigme de l'agent intelligent est devenu largement accepté au cours des années 1990 et sert actuellement de définition du domaine.

Le paradigme a d'autres avantages pour l'IA. Il fournit un moyen fiable et scientifique de tester les programmes ; les chercheurs peuvent directement comparer ou même combiner différentes approches à des problèmes isolés, en se demandant quel agent est le plus apte à maximiser une « fonction de but » donnée. Cela leur donne aussi un langage commun pour communiquer avec d'autres domaines – comme l'optimisation mathématique (qui se définit en termes de « buts ») ou l'économie (qui utilise la même définition d'un « agent rationnel »).

Évaluation des approches de l'IA

Aucune théorie ou paradigme unificateur établi n'a guidé la recherche sur l'IA pendant la majeure partie de son histoire. Le succès sans précédent du machine learning statistique dans les années 2010 a éclipsé toutes les autres approches (à tel point que certaines sources, notamment dans le monde des affaires, utilisent le terme « intelligence artificielle » pour signifier « machine learning avec réseaux de neurones »). Cette approche est principalement sous-symbolique , soignée , douce et étroite (voir ci-dessous). Les critiques soutiennent que ces questions devront peut-être être réexaminées par les futures générations de chercheurs en IA.

L'IA symbolique et ses limites

L'IA symbolique (ou « GOFAI ») simule le raisonnement conscient de haut niveau que les gens utilisent lorsqu'ils résolvent des énigmes, expriment un raisonnement juridique et font des mathématiques. Ils réussissaient très bien dans des tâches "intelligentes" telles que l'algèbre ou les tests de QI. Dans les années 1960, Newell et Simon ont proposé l'hypothèse des systèmes de symboles physiques : "Un système de symboles physiques a les moyens nécessaires et suffisants d'action intelligente générale."

Cependant, l'approche symbolique a lamentablement échoué sur de nombreuses tâches que les humains résolvent facilement, telles que l'apprentissage, la reconnaissance d'un objet ou le raisonnement de bon sens. Le paradoxe de Moravec est la découverte que les tâches "intelligentes" de haut niveau étaient faciles pour l'IA, mais que les tâches "instinctives" de bas niveau étaient extrêmement difficiles. Le philosophe Hubert Dreyfus soutenait depuis les années 1960 que l'expertise humaine dépend de l'instinct inconscient plutôt que de la manipulation consciente des symboles, et du fait d'avoir une « sensation » de la situation, plutôt que d'une connaissance symbolique explicite. Bien que ses arguments aient été ridiculisés et ignorés lorsqu'ils ont été présentés pour la première fois, la recherche sur l'IA a finalement été d'accord.

Le problème n'est pas résolu : le raisonnement sous-symbolique peut commettre bon nombre des mêmes erreurs impénétrables que l'intuition humaine, comme le biais algorithmique . Des critiques tels que Noam Chomsky soutiennent que la poursuite des recherches sur l'IA symbolique sera toujours nécessaire pour atteindre l'intelligence générale, en partie parce que l'IA sous-symbolique s'éloigne de l' IA explicable : il peut être difficile, voire impossible, de comprendre pourquoi un programme d'IA statistique moderne a créé une décision particulière.

Propre vs débraillé

"Neats" espère que le comportement intelligent est décrit à l'aide de principes simples et élégants (tels que la logique , l' optimisation ou les réseaux de neurones ). Les "Scruffies" s'attendent à ce que cela nécessite nécessairement de résoudre un grand nombre de problèmes sans rapport. Cette question a été activement discutée dans les années 70 et 80, mais dans les années 1990, des méthodes mathématiques et des normes scientifiques solides sont devenues la norme, une transition que Russell et Norvig ont qualifiée de "victoire des purs".

Informatique douce vs informatique dure

Trouver une solution prouvée correcte ou optimale est insoluble pour de nombreux problèmes importants. Le soft computing est un ensemble de techniques, comprenant des algorithmes génétiques , de la logique floue et des réseaux de neurones , qui tolèrent l'imprécision, l'incertitude, la vérité partielle et l'approximation. L'informatique logicielle a été introduite à la fin des années 80 et les programmes d'IA les plus réussis du 21e siècle sont des exemples d'informatique logicielle avec des réseaux de neurones .

IA étroite ou générale

Les chercheurs en IA sont divisés quant à savoir s'il faut poursuivre directement les objectifs de l'intelligence artificielle générale et de la superintelligence (IA générale) ou résoudre autant de problèmes spécifiques que possible (IA étroite) dans l'espoir que ces solutions mèneront indirectement aux objectifs à long terme du domaine Général l'intelligence est difficile à définir et difficile à mesurer, et l'IA moderne a connu des succès plus vérifiables en se concentrant sur des problèmes spécifiques avec des solutions spécifiques. Le sous-domaine expérimental de l'intelligence artificielle générale étudie exclusivement ce domaine.

Conscience, sensibilité et esprit de la machine

La philosophie de l'esprit ne sait pas si une machine peut avoir un esprit , une conscience et des états mentaux , au même sens que les êtres humains. Ce problème considère les expériences internes de la machine, plutôt que son comportement externe. La recherche traditionnelle sur l'IA considère que cette question n'est pas pertinente car elle n'affecte pas les objectifs du domaine. Stuart Russell et Peter Norvig observent que la plupart des chercheurs en IA "ne se soucient pas de la [philosophie de l'IA] - tant que le programme fonctionne, ils ne se soucient pas de savoir si vous l'appelez une simulation d'intelligence ou une intelligence réelle". Pourtant, la question est devenue centrale dans la philosophie de l'esprit. C'est aussi typiquement la question centrale en jeu dans l'intelligence artificielle dans la fiction .

Conscience

David Chalmers a identifié deux problèmes dans la compréhension de l'esprit, qu'il a nommés les problèmes "difficiles" et "faciles" de la conscience. Le problème facile est de comprendre comment le cerveau traite les signaux, élabore des plans et contrôle le comportement. Le problème difficile est d'expliquer comment cela se sent ou pourquoi cela devrait ressembler à quoi que ce soit. Le traitement humain de l' information est facile à expliquer, cependant, l'expérience subjective humaine est difficile à expliquer. Par exemple, il est facile d'imaginer une personne daltonienne qui a appris à identifier les objets rouges dans son champ de vision, mais on ne sait pas ce qui serait nécessaire pour que la personne sache à quoi ressemble le rouge .

Computationalisme et fonctionnalisme

Le calculalisme est la position dans la philosophie de l'esprit selon laquelle l'esprit humain est un système de traitement de l'information et que la pensée est une forme d'informatique. Le calculalisme soutient que la relation entre l'esprit et le corps est similaire ou identique à la relation entre le logiciel et le matériel et peut donc être une solution au problème corps-esprit . Cette position philosophique a été inspirée par les travaux des chercheurs en intelligence artificielle et des scientifiques cognitifs dans les années 1960 et a été initialement proposée par les philosophes Jerry Fodor et Hilary Putnam .

Le philosophe John Searle a qualifié cette position d '"IA forte" : "L'ordinateur programmé de manière appropriée avec les bonnes entrées et sorties aurait ainsi un esprit exactement dans le même sens que les êtres humains ont un esprit." Searle contredit cette affirmation avec son argument de la chambre chinoise, qui tente de montrer que, même si une machine simule parfaitement le comportement humain, il n'y a toujours aucune raison de supposer qu'elle a aussi un esprit.

Droits des robots

Si une machine a un esprit et une expérience subjective, alors elle peut aussi avoir une sensibilité (la capacité de ressentir), et si c'est le cas, alors elle pourrait aussi souffrir , et donc elle aurait droit à certains droits. Tout droit hypothétique des robots se situerait sur un spectre comprenant les droits des animaux et les droits de l'homme. Cette question a été considérée dans la fiction pendant des siècles et est maintenant examinée, par exemple, par l' Institute for the Future de Californie , cependant, les critiques soutiennent que la discussion est prématurée.

Avenir

Superintelligence

Une superintelligence, une hyperintelligence ou une intelligence surhumaine est un agent hypothétique qui posséderait une intelligence dépassant de loin celle de l'esprit humain le plus brillant et le plus doué. La superintelligence peut également faire référence à la forme ou au degré d'intelligence possédée par un tel agent.

Si la recherche sur l'intelligence artificielle générale produisait des logiciels suffisamment intelligents, ils pourraient peut-être se reprogrammer et s'améliorer. Le logiciel amélioré serait encore meilleur pour s'améliorer, conduisant à une auto-amélioration récursive . Son intelligence augmenterait de façon exponentielle dans une explosion d'intelligence et pourrait considérablement dépasser les humains. L'écrivain de science-fiction Vernor Vinge a nommé ce scénario la "singularité". Parce qu'il est difficile voire impossible de connaître les limites de l'intelligence ou les capacités des machines superintelligentes, la singularité technologique est un événement au-delà duquel les événements sont imprévisibles voire insondables.

Le concepteur de robots Hans Moravec , le cybernéticien Kevin Warwick et l'inventeur Ray Kurzweil ont prédit que les humains et les machines fusionneront à l'avenir en cyborgs plus capables et plus puissants que les deux. Cette idée, appelée transhumanisme, trouve ses racines chez Aldous Huxley et Robert Ettinger .

Edward Fredkin soutient que "l'intelligence artificielle est la prochaine étape de l'évolution", une idée proposée pour la première fois par " Darwin parmi les machines " de Samuel Butler dès 1863, et développée par George Dyson dans son livre du même nom en 1998.

Des risques

Chômage technologique

Dans le passé, la technologie a eu tendance à augmenter plutôt qu'à réduire l'emploi total, mais les économistes reconnaissent que "nous sommes en territoire inconnu" avec l'IA. Une enquête d'économistes a montré un désaccord quant à savoir si l'utilisation croissante des robots et de l'IA entraînera une augmentation substantielle du chômage de longue durée , mais ils conviennent généralement que cela pourrait être un avantage net si les gains de productivité sont redistribués . Les estimations subjectives du risque varient considérablement ; par exemple, Michael Osborne et Carl Benedikt Frey estiment que 47 % des emplois américains sont à « haut risque » d'automatisation potentielle, tandis qu'un rapport de l'OCDE classe seulement 9 % des emplois américains comme « à haut risque ».

Contrairement aux précédentes vagues d'automatisation, de nombreux emplois de la classe moyenne peuvent être éliminés par l'intelligence artificielle ; The Economist déclare que "l'inquiétude que l'IA pourrait faire aux cols blancs ce que la vapeur a fait aux cols bleus pendant la révolution industrielle" vaut "la peine d'être prise au sérieux". Les emplois à risque extrême vont des parajuristes aux cuisiniers de restauration rapide, tandis que la demande d'emplois est susceptible d'augmenter pour les professions liées aux soins allant des soins de santé personnels au clergé.

Mauvais acteurs et IA armée

L'IA fournit un certain nombre d'outils particulièrement utiles aux gouvernements autoritaires : les logiciels espions intelligents , la reconnaissance faciale et la reconnaissance vocale permettent une surveillance généralisée ; une telle surveillance permet à l'apprentissage automatique de classer les ennemis potentiels de l'État et peut les empêcher de se cacher ; les systèmes de recommandation peuvent cibler précisément la propagande et la désinformation pour un effet maximal ; les deepfakes aident à produire de la désinformation ; L'IA avancée peut rendre la prise de décision centralisée plus compétitive avec les systèmes libéraux et décentralisés tels que les marchés.

Les terroristes, les criminels et les États voyous peuvent utiliser d'autres formes d'IA militarisées telles que la guerre numérique avancée et les armes autonomes létales . En 2015, plus de cinquante pays faisaient des recherches sur les robots de champ de bataille.

L'IA d'apprentissage automatique est également capable de concevoir des dizaines de milliers de molécules toxiques en quelques heures.

Biais algorithmique

Les programmes d'IA peuvent devenir biaisés après avoir appris à partir de données du monde réel. Il n'est généralement pas introduit par les concepteurs du système mais est appris par le programme, et donc les programmeurs ignorent souvent que le biais existe. Un biais peut être introduit par inadvertance par la manière dont les données d'apprentissage sont sélectionnées. Elle peut aussi émerger de corrélations : l'IA est utilisée pour classer les individus en groupes puis faire des prédictions en supposant que l'individu ressemblera aux autres membres du groupe. Dans certains cas, cette hypothèse peut être injuste. COMPAS , un programme commercial largement utilisé par les tribunaux américains pour évaluer la probabilité qu'un accusé devienne un récidiviste , en est un exemple . ProPublica affirme que le niveau de risque de récidive attribué par COMPAS aux accusés noirs est beaucoup plus susceptible d'être surestimé que celui des accusés blancs, malgré le fait que le programme n'a pas été informé des races des accusés. D'autres exemples où le biais algorithmique peut conduire à des résultats injustes sont lorsque l'IA est utilisée pour la notation de crédit ou l'embauche .

Lors de sa conférence 2022 sur l'équité, la responsabilité et la transparence (ACM FAccT 2022), l' Association for Computing Machinery , à Séoul, en Corée du Sud, a présenté et publié des conclusions recommandant que jusqu'à ce qu'il soit démontré que les systèmes d'IA et de robotique sont exempts d'erreurs de biais, ils sont dangereux et l'utilisation de réseaux de neurones auto-apprenants formés sur de vastes sources non réglementées de données Internet erronées devrait être réduite.

Risque existentiel

L'IA superintelligente pourrait être capable de s'améliorer au point que les humains ne pourraient plus la contrôler. Cela pourrait, comme le dit le physicien Stephen Hawking , « signifier la fin de la race humaine ». Le philosophe Nick Bostrom soutient qu'une IA suffisamment intelligente si elle choisit des actions basées sur la réalisation d'un objectif, présentera un comportement convergent tel que l'acquisition de ressources ou la protection contre la fermeture. Si les objectifs de cette IA ne reflètent pas pleinement ceux de l'humanité, elle devra peut-être nuire à l'humanité pour acquérir plus de ressources ou s'empêcher d'être arrêtée, en fin de compte pour mieux atteindre son objectif. Il conclut que l'IA représente un risque pour l'humanité, aussi humbles ou « amicaux » que soient ses objectifs déclarés. Le politologue Charles T. Rubin soutient que "toute bienveillance suffisamment avancée peut être indiscernable de la malveillance". Les humains ne devraient pas supposer que des machines ou des robots nous traiteraient favorablement parce qu'il n'y a aucune raison a priori de croire qu'ils partageraient notre système de moralité.

L'opinion des experts et des initiés de l'industrie est mitigée, avec des fractions importantes à la fois concernées et non concernées par le risque d'une éventuelle IA aux capacités surhumaines. Stephen Hawking , le fondateur de Microsoft Bill Gates , le professeur d'histoire Yuval Noah Harari et le fondateur de SpaceX Elon Musk ont tous exprimé de sérieuses inquiétudes quant à l'avenir de l'IA. D'éminents titans de la technologie, dont Peter Thiel ( Amazon Web Services ) et Musk, ont engagé plus d'un milliard de dollars dans des entreprises à but non lucratif qui défendent le développement responsable de l'IA, telles que OpenAI et le Future of Life Institute . Mark Zuckerberg (PDG, Facebook) a déclaré que l'intelligence artificielle est utile dans sa forme actuelle et continuera à aider les humains. D'autres experts affirment que les risques sont suffisamment éloignés dans le futur pour ne pas valoir la peine d'être étudiés, ou que les humains seront précieux du point de vue d'une machine super intelligente. Rodney Brooks , en particulier, a déclaré que l'IA "malveillante" est encore à des siècles de distance.

Machines éthiques

Les IA conviviales sont des machines qui ont été conçues dès le départ pour minimiser les risques et faire des choix qui profitent aux humains. Eliezer Yudkowsky , qui a inventé le terme, soutient que le développement d'une IA conviviale devrait être une priorité de recherche plus élevée : cela peut nécessiter un investissement important et il doit être achevé avant que l'IA ne devienne un risque existentiel.

Les machines intelligentes ont le potentiel d'utiliser leur intelligence pour prendre des décisions éthiques. Le domaine de l'éthique des machines fournit aux machines des principes et des procédures éthiques pour résoudre les dilemmes éthiques. L'éthique de la machine est également appelée moralité de la machine , éthique computationnelle ou moralité computationnelle, et a été fondée lors d'un symposium AAAI en 2005.

D'autres approches incluent les "agents moraux artificiels" de Wendell Wallach et les trois principes de Stuart J. Russell pour développer des machines dont les avantages sont prouvés.

Régulation

La réglementation de l'intelligence artificielle est l'élaboration de politiques et de lois du secteur public pour promouvoir et réglementer l'intelligence artificielle (IA); elle est donc liée à la régulation plus large des algorithmes. Le paysage réglementaire et politique de l'IA est un problème émergent dans les juridictions du monde entier. Entre 2016 et 2020, plus de 30 pays ont adopté des stratégies dédiées à l'IA. La plupart des États membres de l'UE ont publié des stratégies nationales d'IA, tout comme le Canada, la Chine, l'Inde, le Japon, Maurice, la Fédération de Russie, l'Arabie saoudite, les Émirats arabes unis, les États-Unis et le Vietnam. D'autres étaient en train d'élaborer leur propre stratégie d'IA, notamment le Bangladesh, la Malaisie et la Tunisie. Le Partenariat mondial sur l'intelligence artificielle a été lancé en juin 2020, indiquant la nécessité de développer l'IA conformément aux droits de l'homme et aux valeurs démocratiques, afin de garantir la confiance du public dans la technologie. Henry Kissinger , Eric Schmidt et Daniel Huttenlocher ont publié une déclaration commune en novembre 2021 appelant à une commission gouvernementale pour réglementer l'IA.

Dans la fiction

Les êtres artificiels capables de penser sont apparus comme des dispositifs de narration depuis l'Antiquité et ont été un thème persistant dans la science-fiction .

Un trope commun dans ces œuvres a commencé avec Frankenstein de Mary Shelley , où une création humaine devient une menace pour ses maîtres. Cela inclut des œuvres telles que 2001 : A Space Odyssey d' Arthur C. Clarke et Stanley Kubrick (tous deux de 1968), avec HAL 9000 , l'ordinateur meurtrier responsable du vaisseau spatial Discovery One , ainsi que The Terminator (1984) et The Matrix (1999). ). En revanche, les rares robots fidèles tels que Gort de The Day the Earth Stood Still (1951) et Bishop de Aliens (1986) sont moins présents dans la culture populaire.

Isaac Asimov a introduit les trois lois de la robotique dans de nombreux livres et histoires, notamment la série "Multivac" sur un ordinateur super intelligent du même nom. Les lois d'Asimov sont souvent évoquées lors de discussions profanes sur l'éthique des machines; alors que presque tous les chercheurs en intelligence artificielle connaissent les lois d'Asimov à travers la culture populaire, ils considèrent généralement les lois comme inutiles pour de nombreuses raisons, dont l'une est leur ambiguïté.

Le transhumanisme (la fusion des humains et des machines) est exploré dans le manga Ghost in the Shell et la série de science-fiction Dune .

Plusieurs œuvres utilisent l'IA pour nous obliger à nous confronter à la question fondamentale de ce qui fait de nous des humains, nous montrant des êtres artificiels qui ont la capacité de ressentir , et donc de souffrir. Cela apparaît dans RUR de Karel Čapek , les films AI Artificial Intelligence et Ex Machina , ainsi que le roman Les androïdes rêvent-ils de moutons électriques ? , par Philip K. Dick . Dick considère l'idée que notre compréhension de la subjectivité humaine est altérée par la technologie créée avec l'intelligence artificielle.

Diplomatie scientifique

Guerre

Alors que la technologie et la recherche évoluent et que le monde entre dans la troisième révolution de la guerre après la poudre à canon et les armes nucléaires, la course aux armements de l'intelligence artificielle s'ensuit entre les États-Unis, la Chine et la Russie, trois pays avec les cinq budgets militaires les plus élevés au monde. L'intention d'être un leader mondial de la recherche sur l'IA d'ici 2030 a été déclarée par le dirigeant chinois Xi Jinping, et le président russe Poutine a déclaré que "Quiconque devient le leader dans ce domaine deviendra le dirigeant du monde". Si la Russie devenait le leader de la recherche sur l'IA, le président Poutine a déclaré l'intention de la Russie de partager certaines de leurs recherches avec le monde afin de ne pas monopoliser le domaine, comme leur partage actuel des technologies nucléaires, en maintenant des relations de diplomatie scientifique. Les États-Unis, la Chine et la Russie sont quelques exemples de pays qui ont pris position à l'égard de l'intelligence artificielle militaire dès 2014, ayant établi des programmes militaires pour développer des cyberarmes, contrôler des armes autonomes létales et des drones qui peuvent être utilisés pour surveillance .

Guerre russo-ukrainienne

Le président Poutine a annoncé que l'intelligence artificielle est l'avenir de toute l'humanité et reconnaît le pouvoir et les opportunités que le développement et le déploiement de la technologie d'IA d'armes létales autonomes peuvent détenir dans la guerre et la sécurité intérieure, ainsi que ses menaces. La prédiction du président Poutine selon laquelle les guerres futures seront menées à l'aide de l'IA a commencé à se concrétiser dans une certaine mesure après que la Russie a envahi l'Ukraine le 24 février 2022 . L'armée ukrainienne utilise les drones turcs Bayraktar TB2 qui nécessitent toujours une intervention humaine pour déployer des bombes à guidage laser, mais peuvent décoller, atterrir et naviguer de manière autonome. L' Ukraine utilise également des drones Switchblade fournis par les États-Unis et reçoit des informations collectées par les propres opérations de surveillance des États-Unis concernant le renseignement sur le champ de bataille et la sécurité nationale concernant la Russie. De même, la Russie peut utiliser l'IA pour aider à analyser les données du champ de bataille à partir de séquences de surveillance prises par des drones. Des rapports et des images montrent que l'armée russe a déployé des drones suicides KUB-BLA en Ukraine, avec des spéculations sur l'intention d'assassiner le président ukrainien Volodymyr Zelenskyy .

Règlement de guerre

Au fur et à mesure que la recherche dans le domaine de l'IA progresse, l'utilisation de l'IA est rejetée par la Campagne pour arrêter les robots tueurs et les leaders mondiaux de la technologie ont envoyé une pétition aux Nations Unies appelant à de nouvelles réglementations sur le développement et l'utilisation des technologies de l'IA en 2017, y compris une interdiction de l'utilisation d' armes létales autonomes en raison de préoccupations éthiques pour les populations civiles innocentes.

La cyber-sécurité

Avec les cyberattaques et la génération d'appareils en constante évolution, l'IA peut être utilisée pour la détection des menaces et une réponse plus efficace grâce à la hiérarchisation des risques. Avec cet outil, certains défis sont également présentés tels que la confidentialité, le consentement éclairé et l'utilisation responsable. Selon la CISA , le cyberespace est difficile à sécuriser pour les facteurs suivants : la capacité des acteurs malveillants à opérer de n'importe où dans le monde, les liens entre le cyberespace et les systèmes physiques, et la difficulté de réduire les vulnérabilités et les conséquences dans les cyber-réseaux complexes. Avec les progrès technologiques accrus du monde, le risque d'événements consécutifs à grande échelle augmente. Paradoxalement, la capacité de protéger l'information et de créer une ligne de communication entre la communauté scientifique et diplomatique se développe. Le rôle de la cybersécurité dans la diplomatie est devenu de plus en plus pertinent, créant le terme de cyberdiplomatie – qui n'est pas défini de manière uniforme et n'est pas synonyme de cyberdéfense . De nombreux pays ont développé des approches uniques de la diplomatie scientifique dans le cyberespace.

L'approche de la République tchèque

Cela remonte à 2011, lorsque l' Autorité de sécurité nationale tchèque (NSA) a été nommée autorité nationale pour le cyberagenda. Le rôle de la cyberdiplomatie s'est renforcé en 2017 lorsque le ministère tchèque des Affaires étrangères (MAE) a détecté une sérieuse cybercampagne dirigée contre ses propres réseaux informatiques. En 2016, trois cyber-diplomates ont été déployés à Washington, DC, Bruxelles et Tel-Aviv, dans le but d'établir une coopération internationale active axée sur l'engagement avec l' UE et l'OTAN . Le principal programme de ces efforts de diplomatie scientifique est de renforcer la recherche sur l'intelligence artificielle et la manière dont elle peut être utilisée dans la recherche, le développement et la confiance globale des consommateurs en matière de cybersécurité. CzechInvest est un acteur clé de la diplomatie scientifique et de la cybersécurité. Par exemple, en septembre 2018, ils ont organisé une mission au Canada en septembre 2018 avec un accent particulier sur l'intelligence artificielle. L'objectif principal de cette mission particulière était un effort de promotion au nom de Prague, visant à en faire un futur centre de connaissances pour l'industrie pour les entreprises canadiennes intéressées.

L'approche de l'Allemagne

La cybersécurité est reconnue comme une tâche gouvernementale, divisée en trois ministères de responsabilité : le ministère fédéral de l'Intérieur, le ministère fédéral de la Défense et le ministère fédéral des Affaires étrangères. Ces distinctions ont favorisé la création de diverses institutions, telles que l'Office national allemand de la sécurité de l'information, le Centre national de cyberdéfense, le Conseil national allemand de la cybersécurité et le Cyber and Information Domain Service. En 2018, une nouvelle stratégie pour l'intelligence artificielle a été établie par le gouvernement allemand, avec la création d'un réseau virtuel franco-allemand de recherche et d'innovation, offrant une opportunité d'expansion de la recherche dans la cybersécurité.

L'approche de l'Union européenne

L'adoption de la Stratégie de cybersécurité de l'Union européenne - Un document sur le cyberespace ouvert, sûr et sécurisé en 2013 par la Commission européenne a fait avancer les efforts de cybersécurité intégrés à la diplomatie scientifique et à l'intelligence artificielle. Les efforts sont considérables, car l'UE finance divers programmes et institutions dans le but d'amener la science à la diplomatie et d'amener la diplomatie à la science. Quelques exemples sont le programme de cybersécurité Competence Research Innovation (CONCORDIA), qui rassemble 14 États membres, Cybersecurity for Europe (CSE) - qui rassemble 43 partenaires impliquant 20 États membres. En outre, le réseau européen des centres de cybersécurité et centre de compétences pour l'innovation et les opérations (ECHO) rassemble 30 partenaires avec 15 États membres et SPARTA rassemble 44 partenaires impliquant 14 États membres. Ces efforts reflètent les objectifs généraux de l'UE, à savoir innover en matière de cybersécurité pour la défense et la protection, établir un cyberespace hautement intégré entre de nombreux pays et contribuer davantage à la sécurité de l'intelligence artificielle.

Guerre russo-ukrainienne

Avec l'invasion de l'Ukraine en 2022, il y a eu une augmentation des cyber-activités malveillantes contre les États-Unis, l'Ukraine et la Russie. Une utilisation documentée importante et rare de l'intelligence artificielle dans les conflits est au nom de l'Ukraine, utilisant un logiciel de reconnaissance faciale pour découvrir les assaillants russes et identifier les Ukrainiens tués dans la guerre en cours. Bien que ces personnalités gouvernementales ne se concentrent pas principalement sur la diplomatie scientifique et la cyberdiplomatie, d'autres institutions commentent l'utilisation de l'intelligence artificielle dans la cybersécurité avec cet accent. Par exemple, le Centre pour la sécurité et les technologies émergentes (CSET) de l'Université de Georgetown a le projet Cyber-AI, dont l'un des objectifs est d'attirer l'attention des décideurs sur le nombre croissant de recherches universitaires, qui exposent les conséquences d'exploitation de l'IA et de l'apprentissage automatique (ML ) algorithmes. Cette vulnérabilité peut être une explication plausible de la raison pour laquelle la Russie ne s'engage pas dans l'utilisation de l'IA dans les conflits, selon Andrew Lohn , chercheur principal au CSET. En plus d'être utilisée sur le champ de bataille, l'IA est utilisée par le Pentagone pour analyser les données de la guerre, en analysant pour renforcer la cybersécurité et le renseignement de guerre pour les États-Unis.

Sécurité électorale

À mesure que l'intelligence artificielle se développe et que la quantité écrasante de nouvelles présentées dans le cyberespace se développe, il devient extrêmement difficile pour un électeur de savoir quoi croire. Il existe de nombreux codes intelligents, appelés bots, écrits pour représenter les gens sur les réseaux sociaux dans le but de diffuser des informations manquantes. L'élection américaine de 2016 est victime de telles actions. Pendant la campagne d' Hillary Clinton et de Donald Trump , des robots intelligents artificiels de Russie diffusaient de fausses informations sur les candidats afin d'aider la campagne Trump. Les analystes ont conclu qu'environ 19 % des tweets Twitter centrés sur les élections de 2016 provenaient de bots. Ces dernières années, YouTube a également été utilisé pour diffuser des informations politiques. Bien qu'il n'y ait aucune preuve que la plate-forme tente de manipuler les opinions de ses téléspectateurs, l'algorithme d'IA de Youtube recommande des vidéos de variété similaire. Si une personne commence à rechercher des podcasts politiques de droite , l'algorithme de YouTube recommandera plus de vidéos de droite. Le soulèvement d'un programme appelé Deepfake , un logiciel utilisé pour reproduire le visage et les mots de quelqu'un, a également montré sa menace potentielle. En 2018, une vidéo Deepfake de Barack Obama a été publiée en disant des mots qu'il prétend n'avoir jamais dits. Alors que lors d'une élection nationale, un Deepfake sera rapidement démystifié, le logiciel a la capacité d'influencer fortement une élection locale plus petite . Cet outil recèle un fort potentiel de diffusion de fausses informations et est surveillé avec une grande attention. Bien qu'elle puisse être considérée comme un outil utilisé à des fins nuisibles, l'IA peut également contribuer à améliorer les campagnes électorales. Les robots IA peuvent être programmés pour cibler des articles contenant des informations erronées connues. Les robots peuvent alors indiquer ce qui est mal informé pour aider à faire la lumière sur la vérité. L'IA peut également être utilisée pour informer une personne de la position de chaque partie sur un certain sujet, comme les soins de santé ou le changement climatique . Les dirigeants politiques d'une nation ont une forte influence sur les affaires internationales. Ainsi, un dirigeant politique avec un manque d'intérêt pour l'avancement scientifique collaboratif international peut avoir un impact négatif sur la diplomatie scientifique de cette nation.

Avenir du travail

La reconnaissance faciale

L'utilisation de l'intelligence artificielle (IA) s'est subtilement développée pour faire partie de la vie quotidienne. Il est utilisé au quotidien dans les logiciels de reconnaissance faciale . C'est la première mesure de sécurité pour de nombreuses entreprises sous la forme d'une authentification biométrique. Ce moyen d'authentification permet même aux organisations les plus officielles telles que l'Internal Revenue Service des États-Unis de vérifier l'identité d'une personne via une base de données générée à partir du machine learning. À partir de l'année 2022, l'IRS des États-Unis exige que ceux qui ne subissent pas d'entretien en direct avec un agent effectuent une vérification biométrique de leur identité via l'outil de reconnaissance faciale d'ID.me.

L'IA et l'école

Au Japon et en Corée du Sud, des logiciels d'intelligence artificielle sont utilisés dans l'enseignement de la langue anglaise via la société Riiid. Riiid est une société d'éducation coréenne travaillant aux côtés du Japon pour donner aux étudiants les moyens d'apprendre et d'utiliser leurs compétences en communication en anglais en s'engageant avec l'intelligence artificielle dans un chat en direct. Riid n'est pas la seule entreprise à le faire. Une société américaine comme Duolingo est très connue pour son enseignement automatisé de 41 langues. Babbel , un programme d'apprentissage de la langue allemande utilise également l'intelligence artificielle dans son automatisation de l'enseignement, permettant aux étudiants européens d'acquérir des compétences de communication vitales nécessaires dans les contextes sociaux, économiques et diplomatiques. L'intelligence artificielle automatisera également les tâches de routine que les enseignants doivent effectuer, telles que la notation, la prise de présence et la gestion des demandes de renseignements courantes des étudiants. Cela permet à l'enseignant de poursuivre les complexités de l'enseignement qu'une machine automatisée ne peut pas gérer. Celles-ci incluent la création d'examens, l'explication de matériel complexe d'une manière qui profitera aux étudiants individuellement et la gestion des questions uniques des étudiants.

IA et médecine